Craignez-vous que l’intelligence artificielle se développe trop vite et puisse avoir des conséquences négatives ? Souhaitez-vous qu’il y ait une loi nationale le réglementant ? Aujourd’hui, il n’existe aucune nouvelle loi pour restreindre l’utilisation de l’IA, et l’autorégulation devient souvent la meilleure option pour les entreprises qui adoptent l’IA – du moins pour le moment.

Bien que de nombreuses années se soient écoulées depuis que « l'intelligence artificielle » a remplacé le « big data » en tant que mot à la mode dans le monde de la technologie, le lancement de ChatGPT fin novembre 2022 a déclenché une ruée vers l'or de l'intelligence artificielle, qui a inclus De nombreux observateurs de l’IA, dont nous, sont surpris. En quelques mois seulement, une multitude de puissants modèles d’IA générative ont attiré l’attention du monde entier, grâce à leur remarquable capacité à imiter le langage et la compréhension humains.

L'extraordinaire montée en puissance des modèles génératifs dans la culture dominante, alimentée par l'émergence de ChatGPT, soulève de nombreuses questions sur la direction que tout cela mène. Le phénomène étonnant de l’intelligence artificielle, capable de produire une poésie captivante et un art fantaisiste, cède la place aux inquiétudes quant aux conséquences négatives de l’intelligence artificielle, allant du préjudice causé aux consommateurs et aux pertes d’emplois, jusqu’à l’emprisonnement abusif et même à la destruction de l’humanité.

Cela inquiète beaucoup certaines personnes. Le mois dernier, une coalition de chercheurs en IA a demandé un moratoire de six mois sur le développement de nouveaux modèles génératifs plus grands que GPT-4 (Lectures complémentaires : Une lettre ouverte demande un moratoire sur la recherche en IA), GPT-4, le modèle massif OpenAI lancé le mois dernier. Modèle de langage (LLM).

Une lettre ouverte signée par Yoshua Bengio, lauréat du prix Turing, et Elon Musk, co-fondateur d'OpenAI, entre autres, déclare : « L'intelligence artificielle avancée pourrait représenter de profonds changements dans l'histoire de la vie sur Terre et devrait être planifiée avec la prudence et la prudence appropriées. "Malheureusement, ce niveau de planification et de gestion n'est pas atteint."

Les appels en faveur d'une réglementation de l'IA se multiplient. Les sondages montrent que les Américains ne pensent pas qu’on puisse faire confiance à l’intelligence artificielle et souhaitent qu’elle soit réglementée, en particulier sur des sujets importants comme les voitures autonomes et l’accès aux prestations gouvernementales.

Cependant, malgré plusieurs nouvelles lois locales ciblant l'IA – comme celle de New York qui se concentre sur l'utilisation de l'IA dans les efforts de recrutement et d'application qui ont été retardées jusqu'à ce mois – le Congrès n'a pas spécifiquement adopté de nouvelles réglementations fédérales sur l'intelligence artificielle. la ligne d'arrivée (même si l'IA a déjà fait son chemin dans le domaine juridique de secteurs hautement réglementés comme les services financiers et les soins de santé).

Sous l'impulsion de l'intelligence artificielle, que doit faire une entreprise ? Il n’est pas surprenant que les entreprises souhaitent partager les avantages de l’intelligence artificielle. Après tout, l’envie de s’orienter vers les données est considérée comme une nécessité pour survivre à l’ère numérique. Cependant, les entreprises souhaitent également éviter les conséquences négatives, réelles ou perçues, qui peuvent résulter d’une utilisation inappropriée de l’IA.

L'IA est sauvage dans « Westworld ». Andrew Burt, fondateur du cabinet d'avocats en intelligence artificielle BNH.AI, a déclaré un jour : « Personne ne sait comment gérer les risques. Tout le monde le fait différemment

Cela étant dit, il existe plusieurs cadres que les entreprises peuvent utiliser pour aider à gérer les risques. Intelligence artificielle. Burt recommande d'utiliser le cadre de gestion des risques d'intelligence artificielle (RMF : Risk Management Framework), qui provient du National Institute of Standards and Technology (NIST) et a été finalisé plus tôt cette année.

RMF aide les entreprises à réfléchir au fonctionnement de leur IA et aux conséquences négatives potentielles qu'elle peut avoir. Il utilise une approche « cartographier, mesurer, gérer et gouverner » pour comprendre et finalement atténuer les risques liés à l’utilisation de l’intelligence artificielle dans une variété d’offres de services.

Un autre cadre de gestion des risques liés à l'IA vient de Cathy O'Neil, PDG d'O'Neil Risk Advisory & Algorithmic Auditing (ORCAA). ORCAA a proposé un cadre appelé « Explicable Fairness ».

L'équité explicable donne aux organisations un moyen non seulement de tester les biais de leurs algorithmes, mais également d'étudier ce qui se passe lorsque des différences dans les résultats sont détectées. Par exemple, si une banque détermine l’éligibilité à un prêt étudiant, quels facteurs peuvent légalement être utilisés pour approuver ou refuser le prêt ou facturer des intérêts plus ou moins élevés ?

Évidemment, les banques doivent utiliser les données pour répondre à ces questions. Mais quelles données peuvent-ils utiliser, c’est-à-dire quels facteurs reflètent un demandeur de prêt ? Quels facteurs devraient être légalement autorisés à être utilisés et quels facteurs ne devraient pas être utilisés ? Répondre à ces questions n'est ni facile ni simple, a déclaré O'Neil.

O'Neil a déclaré lors d'une discussion lors de la Nvidia GPU Technology Conference (GTC) le mois dernier : "C'est l'objectif de ce cadre, c'est que ces facteurs juridiques doivent être légalisés

Même sans données." Avec les nouvelles lois sur l'IA, les entreprises devraient commencer à se demander comment mettre en œuvre l'IA de manière équitable et éthique pour se conformer aux lois existantes, a déclaré Triveni Gandhi, responsable de l'analyse et fournisseur de logiciels d'IA Dataiku AI.

« Les gens doivent commencer à réfléchir, d'accord, comment pouvons-nous examiner les lois existantes et les appliquer aux cas d'utilisation de l'IA qui existent actuellement ? « Il y a certaines réglementations, mais il y a aussi beaucoup de réflexion sur quoi ? nous voulons construire l'intelligence artificielle Une approche de l'intelligence éthique et axée sur les valeurs. Ce sont en fait les questions que les entreprises commencent à se poser, même sans réglementation globale

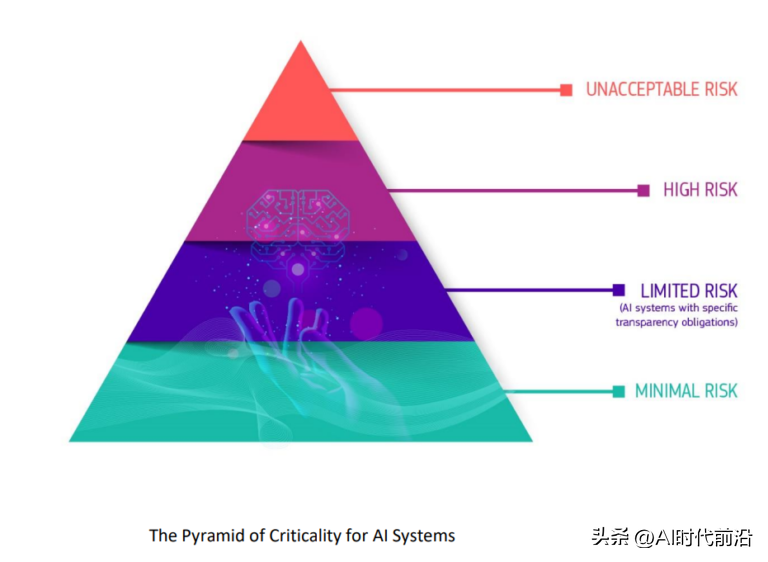

L'UE classe les méfaits potentiels de l'IA comme une menace. « pyramide de criticité »

L'UE avance déjà avec sa propre réglementation, la loi sur l'intelligence artificielle, qui pourrait entrer en vigueur plus tard cette année.

Le projet de loi sur l'intelligence artificielle créera un cadre réglementaire et juridique commun pour l'utilisation de l'intelligence artificielle qui affectera les résidents de l'UE, y compris la manière dont l'IA est développée, les fins pour lesquelles les entreprises peuvent l'utiliser et les lois en cas de non-respect des exigences. en conséquence de. La loi pourrait obliger les entreprises à obtenir une autorisation avant d’adopter l’IA dans certains cas d’usage et interdire certaines autres utilisations de l’IA jugées trop risquées.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Application de l'intelligence artificielle dans la vie

Application de l'intelligence artificielle dans la vie

Quel est le concept de base de l'intelligence artificielle

Quel est le concept de base de l'intelligence artificielle

Ripple a-t-il toujours une valeur d'investissement ?

Ripple a-t-il toujours une valeur d'investissement ?

Comment acheter et vendre du Bitcoin sur okex

Comment acheter et vendre du Bitcoin sur okex

css

css

Comment configurer la mémoire virtuelle

Comment configurer la mémoire virtuelle

Comment créer une base de données dans MySQL

Comment créer une base de données dans MySQL

Le rôle de l'enregistrement d'un serveur cloud

Le rôle de l'enregistrement d'un serveur cloud