Périphériques technologiques

Périphériques technologiques

IA

IA

L'ensemble du processus de déploiement de Yolov sur iPhone ou terminal pratique

L'ensemble du processus de déploiement de Yolov sur iPhone ou terminal pratique

L'ensemble du processus de déploiement de Yolov sur iPhone ou terminal pratique

Le classique de détection tant attendu a une autre vague d'attaques - YOLOv5. Parmi eux, YOLOv5 ne dispose pas de fichiers complets. Le plus important maintenant est de comprendre YOLOv4, qui bénéficiera beaucoup dans le domaine de la détection de cibles et peut être fortement amélioré dans certains scénarios. Aujourd'hui, nous analyserons YOLOv4 pour vous. Dans le prochain numéro, nous nous entraînerons à déployer YOLOv5 sur les téléphones Apple ou à le détecter en temps réel via la caméra du terminal !

1. Revue technologique

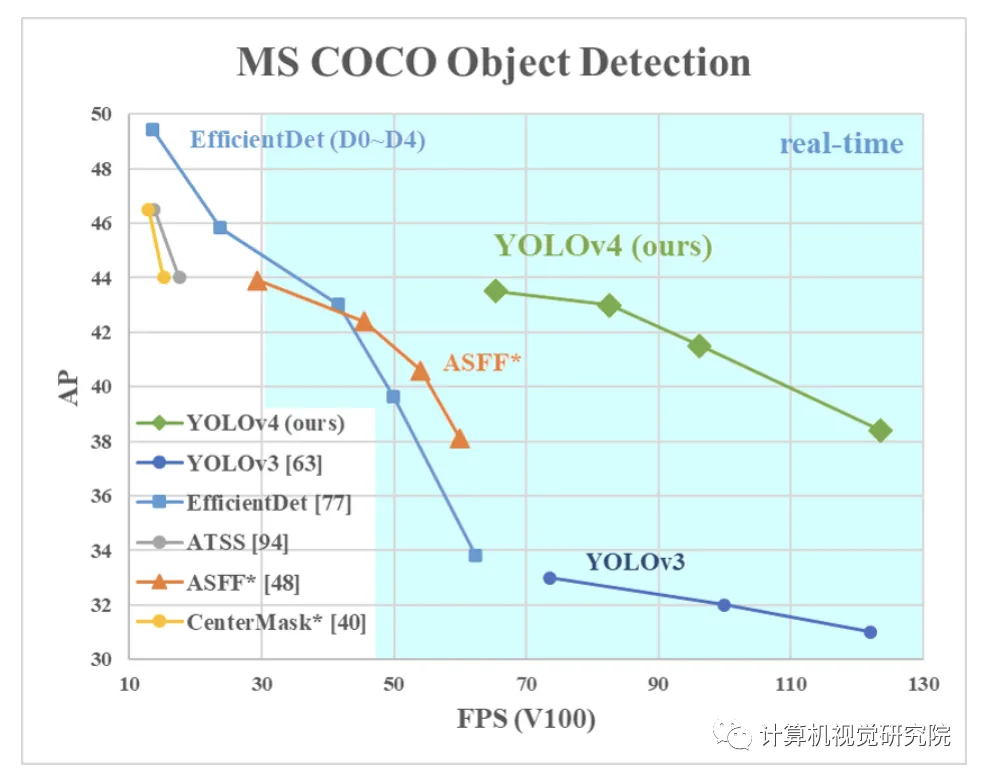

Il existe un grand nombre de fonctionnalités qui sont considérées pour améliorer la précision des réseaux de neurones convolutifs (CNN). Les combinaisons de ces caractéristiques doivent être testées pratiquement sur de grands ensembles de données et les résultats théoriquement validés. Certaines fonctions fonctionnent uniquement sur certains modèles, sur certains problèmes ou sur de petits ensembles de données ; tandis que d'autres fonctions, telles que la normalisation par lots et les jointures résiduelles, fonctionnent sur la plupart des modèles, tâches et ensembles de données. Cet article suppose que ces caractéristiques communes incluent les connexions résiduelles pondérées (WRC), les connexions entre étapes (CSP), la normalisation entre mini-lots (CMbN), l'entraînement auto-adversatif (SAT) et l'activation de Mish. Cet article utilise de nouvelles fonctionnalités : WRC, CSP, CMbN, SAT, activation d'erreur, augmentation des données mosaïque, CMbN, régularisation DropBlock et perte CIoU, et en combine certaines pour obtenir l'effet suivant : 43,5 % AP (65,7 % AP50), en utilisant Ensemble de données MS+COCO, vitesse en temps réel de 65 FPS sur Tesla V100.

2. Analyse des points innovants

Amélioration des données en mosaïque

Mettre quatre images en une seule image pour la formation équivaut à augmenter le mini-lot déguisé. Il s'agit d'une amélioration basée sur CutMix mélangeant deux images

Entraînement auto-adversatif

Sur une image, laissez le réseau neuronal mettre à jour l'image à l'envers et apporter des modifications et des perturbations à l'image. photo. Entraînez-vous ensuite sur cette image. Cette méthode est la principale méthode de stylisation d'image, permettant au réseau de mettre à jour l'image de manière inversée pour styliser l'image.

L'entraînement auto-adversatif (SAT) représente également une nouvelle technique d'augmentation des données qui fonctionne en 2 étapes avant et arrière. Dans la première étape, le réseau neuronal modifie l'image originale au lieu des poids du réseau. une attaque adverse contre lui-même, modifiant l'image originale pour créer la tromperie selon laquelle il n'y a pas d'objet souhaité sur l'image. Dans la 2ème étape, le réseau neuronal est entraîné à détecter un objet sur cette image modifiée de la manière normale.

.

Cross mini-batch Normal

CmBN représente la version modifiée du CBN, comme le montre la figure ci-dessous, définie comme Cross mini-Batch Normalization (CMBN). Cela collecte uniquement des statistiques entre les plus petits lots d'un même lot.

modifier SAM

De l'attention espace par espace de SAM à l'attention point par point;modification du PAN, en changeant le canal de l'ajout (ajouter) à concat.

Expérience

En prenant la méthode d'amélioration des données comme exemple, bien qu'elle augmente le temps de formation, elle peut améliorer les performances et la robustesse de la généralisation du modèle. Par exemple, les méthodes d'amélioration courantes suivantes :

- Perturbation de l'image,

- Changer la luminosité, le contraste, la saturation, la teinte

- Ajouter du bruit

- Mise à l'échelle aléatoire

- recadrage aléatoire

- F lèvre

- Rotation

- effacement aléatoire

- Cutout

- MixUp

- CutMix

On peut voir à travers des expériences qu'il utilise de nombreuses astuces. Le kaléidoscope de détection de cible le plus puissant, le tableau suivant est une expérience sur le. réseau de classification :

CSPResNeXt-50 classifier précision

CSPDarknet-53 classifier précision

Sur le réseau de détection YOLOv4, quatre pertes (GIoU, CIoU, DIoU, MSE), lissage des étiquettes, apprentissage du cosinus taux, sélection d'hyperparamètres d'algorithme génétique, amélioration des données Mosaic et autres méthodes. Le tableau suivant présente les résultats de l'expérience d'ablation sur le réseau de détection YOLOv4 :

CSPResNeXt50-PANet-SPP, 512x512

Utilisation de différents modèles de poids d'entraînement pour l'entraînement :

Résultats de différentes tailles de mini-lots :

Enfin, la comparaison des résultats sur l'ensemble de données COCO sur trois séries différentes de GPU, Maxwell, Pascal et Volta :

Le Ce qui est le plus excitant, c'est que dans l'ensemble de données COCO, la comparaison (vitesse et précision) avec d'autres frameworks :

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

Open source! Au-delà de ZoeDepth ! DepthFM : estimation rapide et précise de la profondeur monoculaire !

Apr 03, 2024 pm 12:04 PM

0. À quoi sert cet article ? Nous proposons DepthFM : un modèle d'estimation de profondeur monoculaire génératif de pointe, polyvalent et rapide. En plus des tâches traditionnelles d'estimation de la profondeur, DepthFM démontre également des capacités de pointe dans les tâches en aval telles que l'inpainting en profondeur. DepthFM est efficace et peut synthétiser des cartes de profondeur en quelques étapes d'inférence. Lisons ce travail ensemble ~ 1. Titre des informations sur l'article : DepthFM : FastMonocularDepthEstimationwithFlowMatching Auteur : MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Tongyi Qianwen est à nouveau open source, Qwen1.5 propose six modèles de volume et ses performances dépassent GPT3.5

Feb 07, 2024 pm 10:15 PM

Tongyi Qianwen est à nouveau open source, Qwen1.5 propose six modèles de volume et ses performances dépassent GPT3.5

Feb 07, 2024 pm 10:15 PM

À temps pour la Fête du Printemps, la version 1.5 du modèle Tongyi Qianwen (Qwen) est en ligne. Ce matin, la nouvelle de la nouvelle version a attiré l'attention de la communauté IA. La nouvelle version du grand modèle comprend six tailles de modèle : 0,5B, 1,8B, 4B, 7B, 14B et 72B. Parmi eux, les performances de la version la plus puissante surpassent GPT3.5 et Mistral-Medium. Cette version inclut le modèle de base et le modèle Chat et fournit une prise en charge multilingue. L'équipe Tongyi Qianwen d'Alibaba a déclaré que la technologie pertinente avait également été lancée sur le site officiel de Tongyi Qianwen et sur l'application Tongyi Qianwen. De plus, la version actuelle de Qwen 1.5 présente également les points forts suivants : prend en charge une longueur de contexte de 32 Ko ; ouvre le point de contrôle du modèle Base+Chat ;

Abandonnez l'architecture codeur-décodeur et utilisez le modèle de diffusion pour la détection des contours avec de meilleurs résultats. L'Université nationale de technologie de la défense a proposé DiffusionEdge.

Feb 07, 2024 pm 10:12 PM

Abandonnez l'architecture codeur-décodeur et utilisez le modèle de diffusion pour la détection des contours avec de meilleurs résultats. L'Université nationale de technologie de la défense a proposé DiffusionEdge.

Feb 07, 2024 pm 10:12 PM

Les réseaux actuels de détection des contours profonds adoptent généralement une architecture d'encodeur-décodeur, qui contient des modules d'échantillonnage ascendant et descendant pour mieux extraire les fonctionnalités à plusieurs niveaux. Cependant, cette structure limite le réseau à produire des résultats de détection de contour précis et détaillés. En réponse à ce problème, un article sur AAAI2024 propose une nouvelle solution. Titre de la thèse : DiffusionEdge : DiffusionProbabilisticModelforCrispEdgeDetection Auteurs : Ye Yunfan (Université nationale de technologie de la défense), Xu Kai (Université nationale de technologie de la défense), Huang Yuxing (Université nationale de technologie de la défense), Yi Renjiao (Université nationale de technologie de la défense), Cai Zhiping (Université nationale de technologie de la défense) Lien vers l'article : https ://ar

Les grands modèles peuvent également être découpés, et Microsoft SliceGPT augmente considérablement l'efficacité de calcul de LAMA-2.

Jan 31, 2024 am 11:39 AM

Les grands modèles peuvent également être découpés, et Microsoft SliceGPT augmente considérablement l'efficacité de calcul de LAMA-2.

Jan 31, 2024 am 11:39 AM

Les grands modèles de langage (LLM) comportent généralement des milliards de paramètres et sont formés sur des milliards de jetons. Cependant, ces modèles sont très coûteux à former et à déployer. Afin de réduire les besoins de calcul, diverses techniques de compression de modèles sont souvent utilisées. Ces techniques de compression de modèles peuvent généralement être divisées en quatre catégories : distillation, décomposition tensorielle (y compris la factorisation de bas rang), élagage et quantification. Les méthodes d'élagage existent depuis un certain temps, mais beaucoup nécessitent un réglage fin de la récupération (RFT) après l'élagage pour maintenir les performances, ce qui rend l'ensemble du processus coûteux et difficile à faire évoluer. Des chercheurs de l'ETH Zurich et de Microsoft ont proposé une solution à ce problème appelée SliceGPT. L'idée principale de cette méthode est de réduire l'intégration du réseau en supprimant des lignes et des colonnes dans la matrice de pondération.

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Bonjour, Atlas électrique ! Le robot Boston Dynamics revient à la vie, des mouvements étranges à 180 degrés effraient Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas entre officiellement dans l’ère des robots électriques ! Hier, l'Atlas hydraulique s'est retiré "en larmes" de la scène de l'histoire. Aujourd'hui, Boston Dynamics a annoncé que l'Atlas électrique était au travail. Il semble que dans le domaine des robots humanoïdes commerciaux, Boston Dynamics soit déterminé à concurrencer Tesla. Après la sortie de la nouvelle vidéo, elle a déjà été visionnée par plus d’un million de personnes en seulement dix heures. Les personnes âgées partent et de nouveaux rôles apparaissent. C'est une nécessité historique. Il ne fait aucun doute que cette année est l’année explosive des robots humanoïdes. Les internautes ont commenté : Les progrès des robots ont fait ressembler la cérémonie d'ouverture de cette année à des êtres humains, et le degré de liberté est bien plus grand que celui des humains. Mais n'est-ce vraiment pas un film d'horreur ? Au début de la vidéo, Atlas est allongé calmement sur le sol, apparemment sur le dos. Ce qui suit est à couper le souffle

Point Transformer mis à jour : plus efficace, plus rapide et plus puissant !

Jan 17, 2024 am 08:27 AM

Point Transformer mis à jour : plus efficace, plus rapide et plus puissant !

Jan 17, 2024 am 08:27 AM

Titre original : PointTransformerV3 : Simpler, Faster, Stronger Lien article : https://arxiv.org/pdf/2312.10035.pdf Lien code : https://github.com/Pointcept/PointTransformerV3 Unité auteur : HKUSHAILabMPIPKUMIT Idée article : Cet article est non destiné à être publié dans À la recherche de l’innovation au sein du mécanisme d’attention. Au lieu de cela, il se concentre sur l’exploitation de la puissance de l’échelle pour surmonter les compromis existants entre précision et efficacité dans le contexte du traitement des nuages de points. S'inspirer des avancées récentes en matière d'apprentissage des représentations 3D à grande échelle,

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

La vitalité de la super intelligence s'éveille ! Mais avec l'arrivée de l'IA qui se met à jour automatiquement, les mères n'ont plus à se soucier des goulots d'étranglement des données.

Apr 29, 2024 pm 06:55 PM

Je pleure à mort. Le monde construit à la folie de grands modèles. Les données sur Internet ne suffisent pas du tout. Le modèle de formation ressemble à « The Hunger Games », et les chercheurs en IA du monde entier se demandent comment nourrir ces personnes avides de données. Ce problème est particulièrement important dans les tâches multimodales. À une époque où rien ne pouvait être fait, une équipe de start-up du département de l'Université Renmin de Chine a utilisé son propre nouveau modèle pour devenir la première en Chine à faire de « l'auto-alimentation des données générées par le modèle » une réalité. De plus, il s’agit d’une approche à deux volets, du côté compréhension et du côté génération, les deux côtés peuvent générer de nouvelles données multimodales de haute qualité et fournir un retour de données au modèle lui-même. Qu'est-ce qu'un modèle ? Awaker 1.0, un grand modèle multimodal qui vient d'apparaître sur le Forum Zhongguancun. Qui est l'équipe ? Moteur Sophon. Fondé par Gao Yizhao, doctorant à la Hillhouse School of Artificial Intelligence de l’Université Renmin.

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

La version Kuaishou de Sora 'Ke Ling' est ouverte aux tests : génère plus de 120 s de vidéo, comprend mieux la physique et peut modéliser avec précision des mouvements complexes

Jun 11, 2024 am 09:51 AM

Quoi? Zootopie est-elle concrétisée par l’IA domestique ? Avec la vidéo est exposé un nouveau modèle de génération vidéo domestique à grande échelle appelé « Keling ». Sora utilise une voie technique similaire et combine un certain nombre d'innovations technologiques auto-développées pour produire des vidéos qui comportent non seulement des mouvements larges et raisonnables, mais qui simulent également les caractéristiques du monde physique et possèdent de fortes capacités de combinaison conceptuelle et d'imagination. Selon les données, Keling prend en charge la génération de vidéos ultra-longues allant jusqu'à 2 minutes à 30 ips, avec des résolutions allant jusqu'à 1080p, et prend en charge plusieurs formats d'image. Un autre point important est que Keling n'est pas une démo ou une démonstration de résultats vidéo publiée par le laboratoire, mais une application au niveau produit lancée par Kuaishou, un acteur leader dans le domaine de la vidéo courte. De plus, l'objectif principal est d'être pragmatique, de ne pas faire de chèques en blanc et de se mettre en ligne dès sa sortie. Le grand modèle de Ke Ling est déjà sorti à Kuaiying.