Kurs Dazwischenliegend 5430

Kurseinführung:Flutter是谷歌的移动UI框架,可以快速在iOS和Android上构建高质量的原生用户界面。 Flutter可以与现有的代码一起工作。在全世界,Flutter正在被越来越多的开发者和组织使用,并且Flutter是完全免费、开源的。我们将在这里揭开他可爱而神奇的面纱。

Kurs Grundschule 12859

Kurseinführung:从初、中级读者角度出发,通过通俗易懂的语言、丰富多彩的实例,详细介绍了使用Android要掌握的知识,使用Android Studio开发工具,从一个Android应用讲解,由浅入深,让同学们逐步掌握Android的精髓。

Kurs Grundschule 7744

Kurseinführung:01-NodeJS(简介、安装、常用模块、留言板) 02-NodeJS(NPM使用、模板引擎、Express框架) 03-NodeJS(Express框架学生项目、登录注册、中间件、会话技术、错误处理) 04-NodeJS(ES6、网络爬虫、MySQL、koa2框架学生项目)

Kurs Dazwischenliegend 19763

Kurseinführung:ThinkPHP6基于精简核心和统一用法两大原则在5.1的基础上对底层架构做了进一步的优化改进,并更加规范化。由于引入了一些新特性,ThinkPHP6运行环境要求PHP7.1+,不支持5.1的无缝升级。

2017-06-06 09:52:55 0 2 986

php - Hilfe zur Array-Reorganisation~~

2017-06-06 09:54:16 0 3 643

2017-06-06 09:54:18 0 2 1050

http – Nginx-Reverse-Proxy-URL-Fehler

2017-06-06 09:54:28 0 1 1181

Frontend – So beschleunigen Sie die Ladegeschwindigkeit von CSS-Hintergrundbildern

2017-06-06 09:54:29 0 6 1207

Kurseinführung:Chain of Thought Tips (CoT) ist eines der mysteriösesten Phänomene bei der Entstehung großer Modelle, insbesondere bei der Lösung mathematischer Argumentations- und Entscheidungsprobleme. Es hat erstaunliche Ergebnisse erzielt. Wie wichtig ist CoT? Was ist der Mechanismus hinter seinem Erfolg? In diesem Artikel beweisen mehrere Forscher der Peking-Universität, dass CoT für die Realisierung von LLM-Inferenzen (Large Language Model) unverzichtbar ist, und zeigen, wie CoT das enorme Potenzial von LLM aus theoretischer und experimenteller Sicht freisetzen kann. Jüngste Untersuchungen haben ergeben, dass Chain of Thought Prompting (CoT) die Leistung großer Sprachmodelle (LLM) erheblich verbessern kann und sich besonders für die Verarbeitung komplexer Aufgaben im Bereich Mathematik oder Argumentation eignet. Doch trotz seines großen Erfolgs sind die Mechanismen hinter CoT und wie

2023-06-03 Kommentar 0 997

Kurseinführung:Tauschen Sie sich gegenseitig aus, damit kleine Modelle große Probleme lösen können. Wie wir alle wissen, ist LLM leistungsstark, aber seine Fähigkeit, komplexe Überlegungen anzustellen, ist nicht stark genug. Beispielsweise kann Mistral-7B im GSM8K-Datensatz nur eine Genauigkeit von 36,5 % erreichen, selbst wenn es Technologien wie Chain of Thought (CoT) nutzt. Obwohl eine Feinabstimmung die Denkfähigkeit tatsächlich effektiv verbessern kann, basieren die meisten LLM auf der Feinabstimmung von Daten, die von leistungsfähigeren Modellen wie GPT-4 destilliert wurden oder möglicherweise sogar von diesen leistungsstarken Modellen synthetisiert wurden. Gleichzeitig entwickeln Forscher auch aktiv eine zusätzliche, aber schwierigere Methode: den Einsatz eines besseren LLM-Lehrers zur Verbesserung der Denkfähigkeit. Um die Denkfähigkeit ohne ein besseres Modell zu verbessern, ist dies ein vielversprechendes Paradigma

2024-08-16 Kommentar 0 962

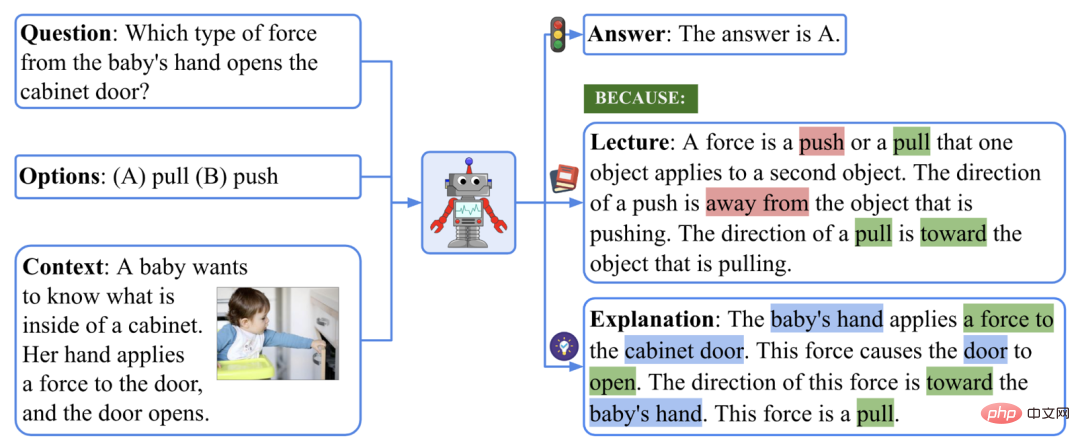

Kurseinführung:Bei der Beantwortung komplexer Fragen kann der Mensch Informationen auf unterschiedliche Weise verstehen und eine vollständige Gedankenkette (Chain of Thought, CoT) bilden. Kann das Deep-Learning-Modell die „Black Box“ öffnen und eine Denkkette für seinen Argumentationsprozess bereitstellen? Kürzlich haben die UCLA und das Allen Institute for Artificial Intelligence (AI2) ScienceQA vorgeschlagen, den ersten multimodalen wissenschaftlichen Frage-Antwort-Datensatz mit detaillierten Erklärungen, um die multimodalen Argumentationsfähigkeiten des Modells zu testen. In der ScienceQA-Aufgabe schlug der Autor das GPT-3 (CoT)-Modell vor, das schnelles Lernen basierend auf Gedankenketten in das GPT-3-Modell einführte, sodass das Modell bei der Generierung von Antworten entsprechende Begründungserklärungen generieren kann. G

2023-04-11 Kommentar 0 993

Kurseinführung:Unterschied: JPEG2000 ist eine aktualisierte Version von JPEG und seine Komprimierungsrate ist etwa 30 % höher als die von JPEG. JPEG2000 ersetzt 8X8DCT durch Wavelet-Transformation und die effiziente Datenorganisationsmethode EB-COT und verwendet arithmetische Codierung, wodurch die Codierungsleistung im Vergleich zu JPEG bei gleichem Komprimierungsverhältnis um etwa 2 dB verbessert wird.

2021-01-07 Kommentar 0 26470