In den letzten Jahren wurden im Bereich des maschinellen Lernens viele große Durchbrüche erzielt, und auch auf der Technologie der künstlichen Intelligenz basierende Personalmanagement-Dienstleistungsprodukte haben einen riesigen und dynamischen Markt. Immer mehr Unternehmen und Regierungsbehörden denken nach und nach darüber nach, maschinelle Lerntechnologie auf das Personalmanagement anzuwenden, mithilfe neuronaler Netze effektive Entscheidungen zu treffen und die Ergebnisse des Personalmanagements genau vorherzusagen.

In diesem Artikel werden vier Aspekte der Anwendung von maschinellem Lernen in der Personalmanagementforschung vorgestellt, darunter hauptsächlich technische Schwierigkeiten, eine Einführung in Entscheidungssysteme im Personalmanagement, Systemdesignmethoden und Systemsicherheit. Wir hoffen, dass die Leser ein vorläufiges Verständnis davon erhalten verwandte Forschung.

Im Jahr 2019 führten CEOs von 20 großen Unternehmen in den USA entsprechende Seminare durch. Die Ergebnisse zeigten, dass die Anwendung der maschinellen Lerntechnologie im Bereich des Personalmanagements vor einzigartigen Herausforderungen steht. Die Entwicklung wertvoller HRM-Entscheidungssysteme birgt nicht nur technische Herausforderungen, sondern auch Hindernisse bei der Übertragung der inhärenten Komplexität von HRM-Ergebnissen sowie schwierig zu berücksichtigende Daten, ethische und rechtliche Einschränkungen und Bedenken hinsichtlich der Auswahl betroffener Mitarbeiter oder anderer Interessengruppen Prozess, den einige für umstritten halten. Bei Entscheidungen des Personalmanagements müssen Auswahlverfahren vermieden werden, die rechtlich anfechtbar sind oder von Mitarbeitern oder anderen Interessengruppen als kontrovers angesehen werden.

Die Zusammenfassung umfasst die folgenden Aspekte:

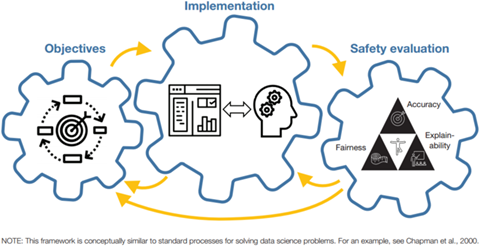

Figure Machine Learning System Framework

Figure Machine Learning System Framework

Bild

Bild

Maschinelle Lernsysteme, die narrative Aufzeichnungen automatisch zusammenfassen, können als Modell für die Entscheidungsunterstützung dienen. Die meisten HR-Datensätze einer Person sind in zwei Arten von Freitext und Personenattributen unterteilt. Freiformtext wie Aufgabenlisten, Beschreibungen von Verantwortlichkeiten und Zusammenfassungen wichtiger Erfolge. Bei Personalattributen handelt es sich um vorab quantifizierte, interpretierbare, für das Management nützliche Daten, wie z. B. jahrelange Erfahrung, Rangfolge oder Beförderungstestergebnisse. Während die letztere Art von Informationen einfacher zu verarbeiten und in Modellen oder Visualisierungen zu verwenden ist, wird die erstere Art von Informationen auch benötigt, um fundierte Entscheidungen im Personalmanagement zu treffen.

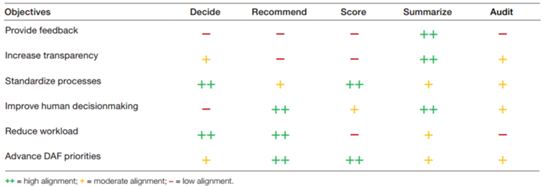

Managemententscheidungen erfordern eine sorgfältige Überprüfung der Aufzeichnungen und einen manuellen Überprüfungs- oder Bewertungsprozess durch erfahrenes Personal. Von den verschiedenen Entwurfsimplementierungen, die zur Unterstützung der manuellen Überprüfung in Betracht gezogen werden, ist „Zusammenfassung“ die vielseitigste. Dies ist das einzige Design, das mäßig oder sehr gut mit allen Zielen des Personalmanagements übereinstimmt. Automatisierte Zusammenfassungen sind nützlich, um Feedback zu geben, die Transparenz zu erhöhen und die Genauigkeit der menschlichen Entscheidungsfindung zu verbessern, und sie sind zumindest einigermaßen nützlich, um den manuellen Arbeitsaufwand zu standardisieren und zu reduzieren. Gleichzeitig behält die summarische Implementierung ein hohes Maß an manueller Kontrolle über den Entscheidungsprozess bei, sodass es wahrscheinlicher ist als bei anderen Designs, dass sie Sicherheitsstandards erfüllt. Tatsächlich hebt die Zusammenfassung die Elemente des Textes hervor, die das System für wichtig hält, und stellt daher eine Erläuterung der Entscheidungen des Systems dar. Daher können Zusammenfassungen als nützliche Hilfe dienen, um Managern dabei zu helfen, Modellausgaben in anderen Entwurfsimplementierungen zu verstehen.

Entscheidungen im Personalmanagement sind eine entscheidende Kraft, die sich auf die Zukunft des Unternehmens auswirkt. Daher muss bei wesentlichen Änderungen im Entscheidungsprozess der Grundsatz „Zuerst keinen Schaden anrichten“ befolgt werden. Da die Investitionen in maschinelles Lernen steigen, zielen zahlreiche Forschungs- und Strategiedokumente darauf ab, normative Leitlinien für den verantwortungsvollen und ethischen Einsatz von maschinellem Lernen (und künstlicher Intelligenz im weiteren Sinne) bereitzustellen.

So gelten beispielsweise bestehende Regeln und Rahmenwerke zum Schutz der Privatsphäre der Mitglieder weiterhin für alle Entwicklungsprojekte. Während der Entwicklung und Bereitstellung gibt es drei Prinzipien, die besonders für Testsysteme relevant sind, die Genauigkeit, Fairness und Interpretierbarkeit von maschinellen Lernsystemen erfordern:

Genauigkeit bedeutet, dass ein maschinelles Lernsystem oder das darin enthaltene Modell das Interesse mit einem hohen Wert korrekt vorhersagt Wahrscheinlichkeit das Ergebnis von.

Fairness bedeutet, dass das maschinelle Lernsystem Untergruppen gleich behandelt.

Erklärbarkeit bedeutet, dass Menschen die Faktoren und Beziehungen verstehen können, die zu den Ergebnissen eines maschinellen Lernsystems führen.

Diese Sicherheitsstandards stehen manchmal im Widerspruch zueinander. Um die Fairness zu erhöhen, können Designer dem System Einschränkungen auferlegen, die seine Genauigkeit oder Interpretierbarkeit verringern. Um die Interpretierbarkeit zu verbessern, verwenden Systementwickler möglicherweise besser interpretierbare (aber weniger flexible) Modellierungsmethoden, was sich auf Genauigkeit und Fairness auswirken kann. Beim Testen müssen Genauigkeit, Fairness und Interpretierbarkeit gegeneinander abgewogen werden, um zu einem Design zu gelangen, das den Zielen des Personalmanagements sowie rechtlichen und ethischen Einschränkungen entspricht.

In Bezug auf Fairness ist es wichtig zu beachten, dass es keine einheitliche Definition von Fairness gibt und es oft unmöglich ist, konkurrierende Arten von Fairness zu erfüllen. Daher müssen Agenturen eine Definition wählen, um mit dem Testen voranzukommen. Dabei wird zwischen prozeduraler Fairness, die sicherstellt, dass ein HR-Management-Prozess oder Algorithmus Mitglieder unterschiedlicher Untergruppen gleich behandelt, und Outcome-Fairness, die prüft, ob ein Modell- oder Prozessergebnis verzerrt ist, unterschieden.

Schließlich ist die Erklärbarkeit von entscheidender Bedeutung für das Erreichen von HRM-Zielen, da Menschen das System möglicherweise ignorieren oder missbrauchen, wenn sie nicht verstehen, wie es zu einer besseren Entscheidungsfindung beiträgt. Darüber hinaus ist die Definition der Erklärbarkeit untrennbar mit der Zielgruppe verbunden, da unterschiedliche Benutzertypen unterschiedliche Erklärungsebenen erfordern. Designer können die Verwendung von inhärent interpretierbaren Modellen in Betracht ziehen, um die Interpretierbarkeit zu verbessern, und sie können auch Human-in-the-Loop-Tests durchführen, um zu beurteilen, wie gut Menschen die Funktionalität des Systems verstehen.

Dieser Artikel stellt hauptsächlich kurz die Forschung zum maschinellen Lernen im Bereich Personalmanagement unter vier Aspekten vor: technische Schwierigkeiten, Einführung in Entscheidungssysteme im Personalmanagement, Systemdesignmethoden und Systemsicherheit. Wir hoffen, dass es für Leser hilfreich sein kann, die sich ein erstes Verständnis dieser Forschung verschaffen möchten.

Das obige ist der detaillierte Inhalt vonSprechen wir über die Kollision zwischen maschinellem Lernen und Personalmanagement?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Welche E-Commerce-Plattformen gibt es?

Welche E-Commerce-Plattformen gibt es?

Was ist ein Festplattenkontingent?

Was ist ein Festplattenkontingent?

Die zehn besten Börsen für digitale Währungen

Die zehn besten Börsen für digitale Währungen

Einführung in das Dex-Konzept der digitalen Währung

Einführung in das Dex-Konzept der digitalen Währung

So zeigen Sie gespeicherte Prozeduren in MySQL an

So zeigen Sie gespeicherte Prozeduren in MySQL an

Welche Zeichensoftware gibt es?

Welche Zeichensoftware gibt es?

Der Unterschied zwischen statischen Webseiten und dynamischen Webseiten

Der Unterschied zwischen statischen Webseiten und dynamischen Webseiten

Einführung in Laravel-Komponenten

Einführung in Laravel-Komponenten