(Nweon, 26. Dezember 2023) Die Entwicklung von Remote-Meetings fördert die Popularisierung des Metaversums. Derzeit besteht jedoch bei Online-Meeting-Anwendungen bei der Verwendung von Metaumgebungen ein großes Problem darin, dass nicht alle Teilnehmer denselben Gerätetyp verwenden. Einige Benutzer verwenden beispielsweise PCs zur Bedienung, während andere Virtual-Reality-Headsets verwenden

Desktop-Benutzer sind manchmal im Nachteil, weil sie nicht mit allen Benutzern in der virtuellen Umgebung navigieren oder mit ihnen interagieren können. Während ein Computer eine 2D-Ansicht einer 3D-Umgebung bereitstellt, ist der Computer nur begrenzt in der Lage, Eingabegesten vom Benutzer zu empfangen, um in der 3D-Umgebung zu navigieren oder mit ihr zu interagieren.

Aus heutiger Sicht ist die Erfahrung von VR-Headset-Benutzern und PC-Benutzern nicht die gleiche, obwohl sich die Technologie rasant weiterentwickelt. Unabhängig davon, ob Sie von einem VR-Headset zu einem Desktop-Gerät wechseln oder umgekehrt, ermöglichen bestehende Systeme keinen nahtlosen Wechsel bei Veranstaltungen wie Partys oder Firmentreffen

Eine verwandte nahtlose Übergangsmethode wird in einer Microsoft-Patentanmeldung mit dem Titel „Rendering von 2D- und 3D-Übergängen in benutzerbezogenen Kommunikationssitzungen“

detailliert beschrieben

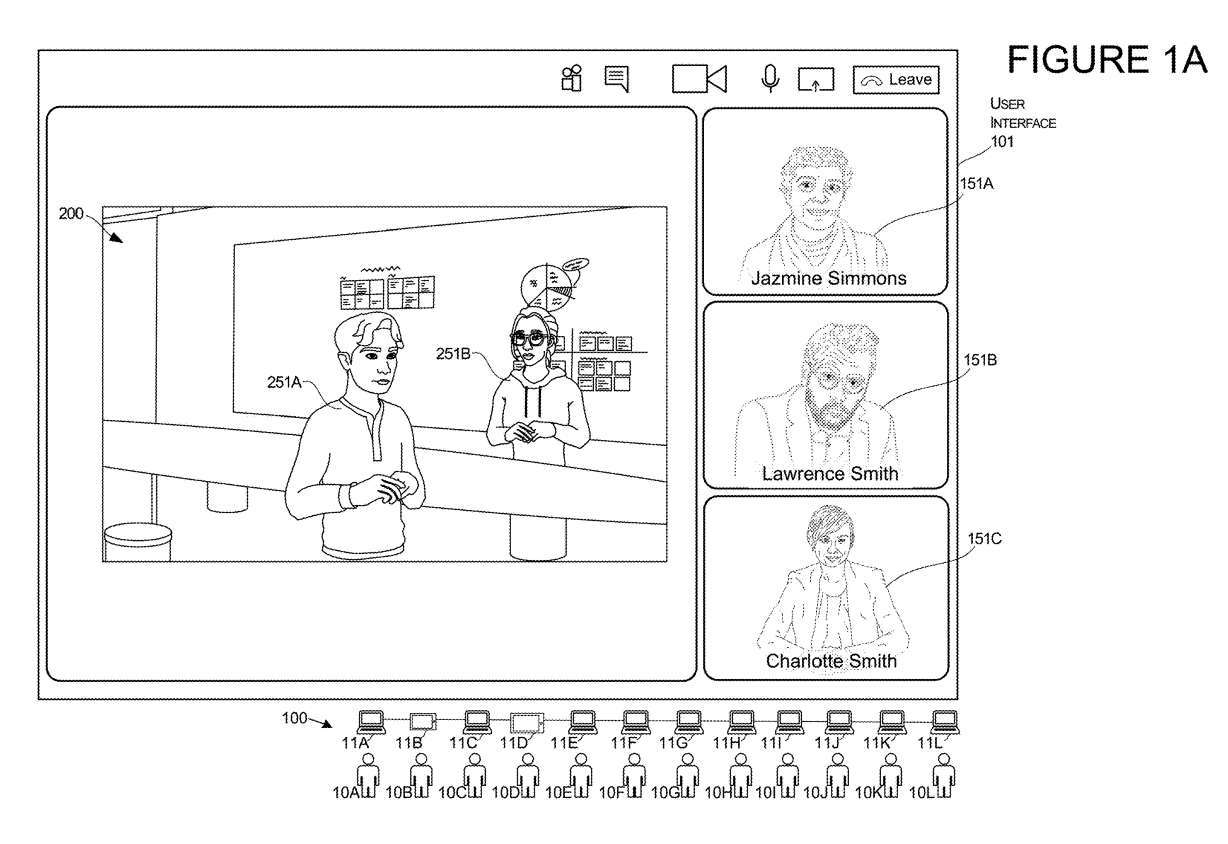

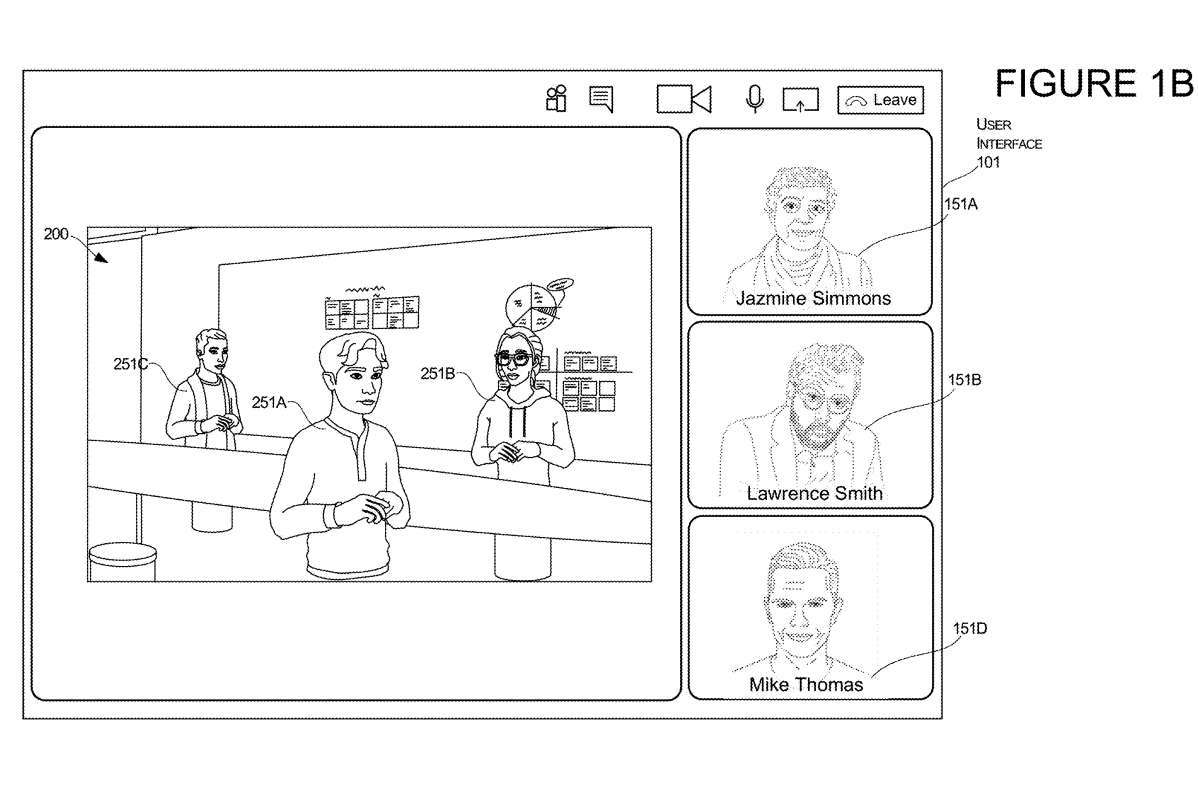

Die Abbildungen 1A und 1B veranschaulichen den Übergang einer Benutzeroberflächenanordnung von der Anzeige eines zweidimensionalen Bildes des Benutzers zur Darstellung einer dreidimensionalen Darstellung des Benutzers, während der Benutzer an einer Kommunikationssitzung beteiligt ist.

Die Kommunikationssitzung kann von einem System 100 verwaltet werden, das aus mehreren Computern 11 besteht, wobei jeder Computer 11 einer Vielzahl von Benutzern 10 entspricht. In diesem Beispiel wird die Präsentation des dritten Benutzers 10C vom 2D-Modus in den 3D-Modus konvertiert.

Um einen Übergang einzuleiten, kann das System eine Eingabe empfangen, um einen Anzeigeübergang der 2D-Bildwiedergabe eines bestimmten Benutzers zu veranlassen. In diesem Beispiel identifiziert die Eingabe den dritten Benutzer 10C. Diese Eingabe kann auch die Erlaubnis bereitstellen, dem System den Zugriff auf das 3D-Modell zu ermöglichen, das den Standort und die Ausrichtung für den dritten Benutzer 10C definiert. Diese Positionen und Richtungen können Vektoren und Koordinaten umfassen, die in der 3D-Umgebung 200 dargestellt werden, die hier als virtuelle Umgebung 200 bezeichnet wird

Als Reaktion auf den Empfang von Eingaben können ein oder mehrere Computer des Systems 100 Änderungen an der Benutzeroberfläche 101 vornehmen, um die Darstellung des Bildes 151C für Benutzer 10C zu entfernen, wie in Abbildung 1A gezeigt, und den Benutzer hinzuzufügen, wie in Abbildung 1B gezeigt. Die 3D-Darstellung von Der 10C ist die Wiedergabe des 251C. Die Darstellung der 3D-Darstellung 251C des Benutzers 10C kann in der 3D-Umgebung basierend auf den im 3D-Modell definierten Koordinaten und/oder Vektoren positioniert und ausgerichtet werden.In diesem Beispiel wurde das Rendering des 2D-Bildes von Benutzer 10C entfernt und kann dann durch ein anderes Rendering ersetzt werden. Beispielsweise wird das in FIG. 1A gezeigte 2D-Bild des dritten Benutzers 10C in der Benutzeroberfläche durch ein anderes 2D-Bild eines anderen Benutzers, des in FIG. 1B gezeigten vierten Benutzers, ersetzt.

Diese Transformation ermöglicht es Benutzern, auf unterschiedliche Weise mit Computergeräten zu interagieren. Wenn Benutzer 10C in diesem Beispiel beispielsweise von Live-Video-Streaming in einer Kommunikationssitzung zu einem anderen Betriebsmodus wechseln möchte, der es dem Benutzer ermöglicht, mit anderen Benutzern in einer 3D-Umgebung zu interagieren, wechselt das System den Benutzer von einem Modus in einen anderen Modus, der die Interaktion mit allgemeinen Inhalten, Dokumenten, Tabellenkalkulationen und Folien ermöglicht, und in einen Modus, der die Interaktion mit 3D-Objekten ermöglicht

Dieser Übergang während Kommunikationssitzungen ermöglicht es ausgewählten Benutzern, Bearbeitungstools zu verwenden, die für verschiedene Inhaltstypen in jeder Umgebung geeignet sind. Wenn beispielsweise eine Person in einem Videostream den 2D-Modus mit 2D-Bildern, die dem Benutzer angezeigt werden, verlassen und in eine 3D-Umgebung wechseln möchte, um anderen Benutzern zu zeigen, wie sie Objekte an bestimmten Orten verschieben oder bestimmte 3D-Objekte formen können, dann ist dies der Fall, sobald der Benutzer dies tut Durch den Wechsel können sie dies einfacher tun.

Benutzer können diese Konvertierung mit einem Desktop-PC durchführen, ohne ein XR-Headset zu verwenden. Diese Transformation mithilfe des Desktops ermöglicht es dem Benutzer, über den Desktop-Computer in einen 3D-Interaktionsmodus mit der 3D-Computerumgebung zu wechseln, der möglicherweise besser zum Bearbeiten oder Anzeigen bestimmter Arten von Inhalten geeignet ist.

Microsoft wies darauf hin, dass einer der technischen Vorteile darin besteht, dass das System es Benutzern ermöglichen kann, zwischen dem 3D-Modus und dem 2D-Modus der Kommunikationssitzung zu wechseln, unabhängig davon, mit welcher Hardware sie interagieren.

Die in der Erfindung genannte Technologie ist auch auf Head-Mounted-Displays anwendbar. In solchen Ausführungsformen kann der Benutzer weiterhin nur ein Computergerät verwenden, beispielsweise ein Head-Mounted-Display, während er das interaktive Modell von einer 3D-Computerumgebung in eine 2D-Computerumgebung überführt. Daher kann ein Benutzer in eine 3D-Computerumgebung starten und durch eine Präsentation der 3D-Darstellung 251C repräsentiert werden, wie beispielsweise die in Abbildung 1B gezeigte Darstellung.

Dann kann das System als Reaktion auf eine oder mehrere Eingaben, beispielsweise wenn ein Benutzer beginnt, Inhalte mit einem bestimmten Dateityp zu bearbeiten, oder basierend auf einer Eingabe, die eine Absicht zur Durchführung einer UI-Transformation anzeigt, die UI transformieren, um das Rendering des zu entfernen Es wird eine 3D-Darstellung 251C, wie in Abbildung 1B gezeigt, und eine Darstellung des 2D-Bildes 151C des Benutzers erzeugt, wie beispielsweise die in Abbildung 1A gezeigte Darstellung. Dadurch können Benutzer mithilfe eines Flachbildschirms und einer Tastatur zu einer 2D-Umgebung wechseln, ohne tatsächlich ein Desktop-Gerät zu verwenden.

Die Abbildungen 2A und 2B veranschaulichen ein weiteres Beispiel für den Übergang einer Benutzeroberfläche von einer Anzeige mit einem zweidimensionalen Bild des Benutzers zu einer Darstellung einer dreidimensionalen Darstellung des Benutzers, wenn der Benutzer an einer Kommunikationssitzung beteiligt ist.

In diesem Beispiel ist die Benutzeroberfläche 201 eine Darstellung einer 3D-Umgebung basierend auf einem 3D-Modell. Die Benutzeroberfläche 201 beginnt mit einer 3D-Darstellung der Darstellung 251A des ersten Benutzers 10A und einer 3D-Darstellung der Darstellung 251B des zweiten Benutzers 10B. Jedes dargestellte 3D-Rendering hat eine Position und eine Ausrichtung, die durch die im 3D-Modell gespeicherten virtuellen Objekteigenschaften bestimmt werden

Zur 3D-Umgebung gehört auch ein virtuelles Objekt 275 in Form eines virtuellen Flachbildfernsehers, der an der Wand der virtuellen Umgebung montiert ist. Das virtuelle Objekt 275 verfügt über eine Anzeigeoberfläche, die eine virtuelle Benutzeroberfläche anzeigt, die eine 2D-Darstellung 151C des dritten Benutzers 10C und eine 2D-Darstellung 151D des vierten Benutzers 10D anzeigt.

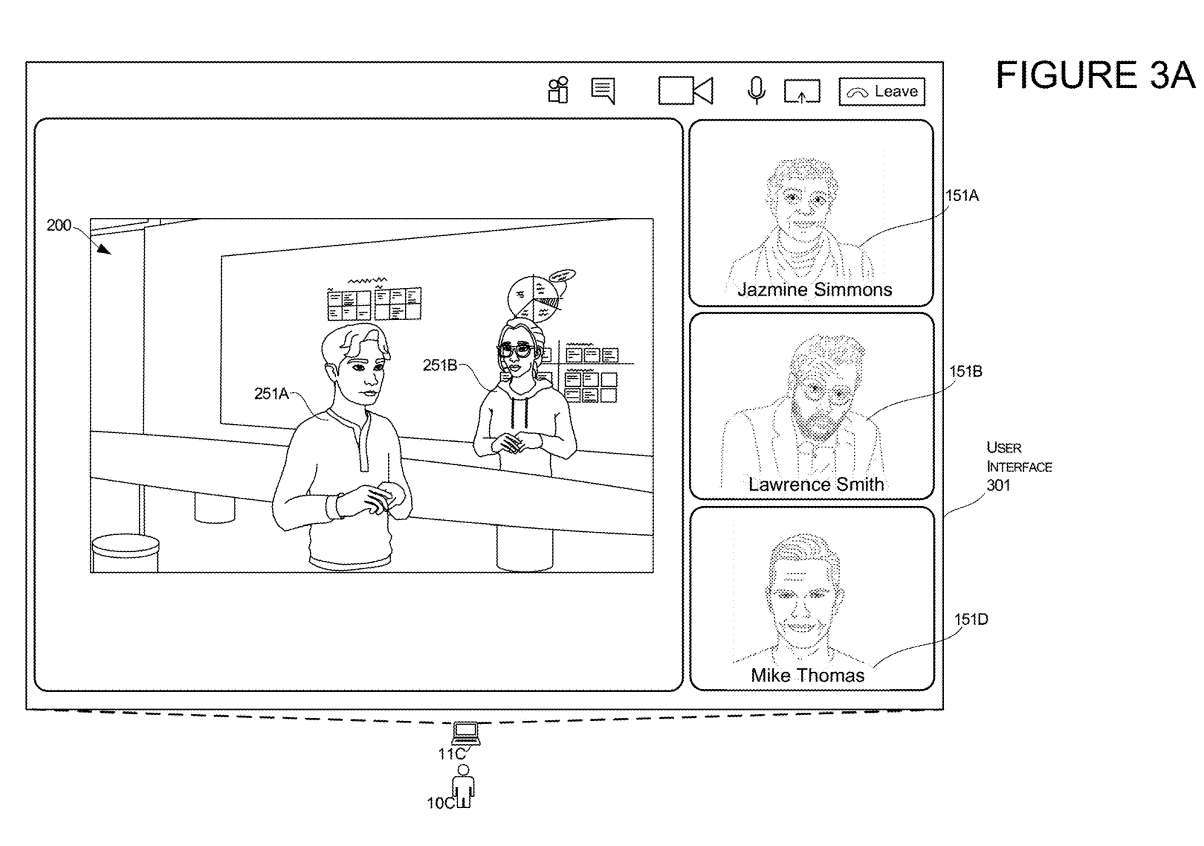

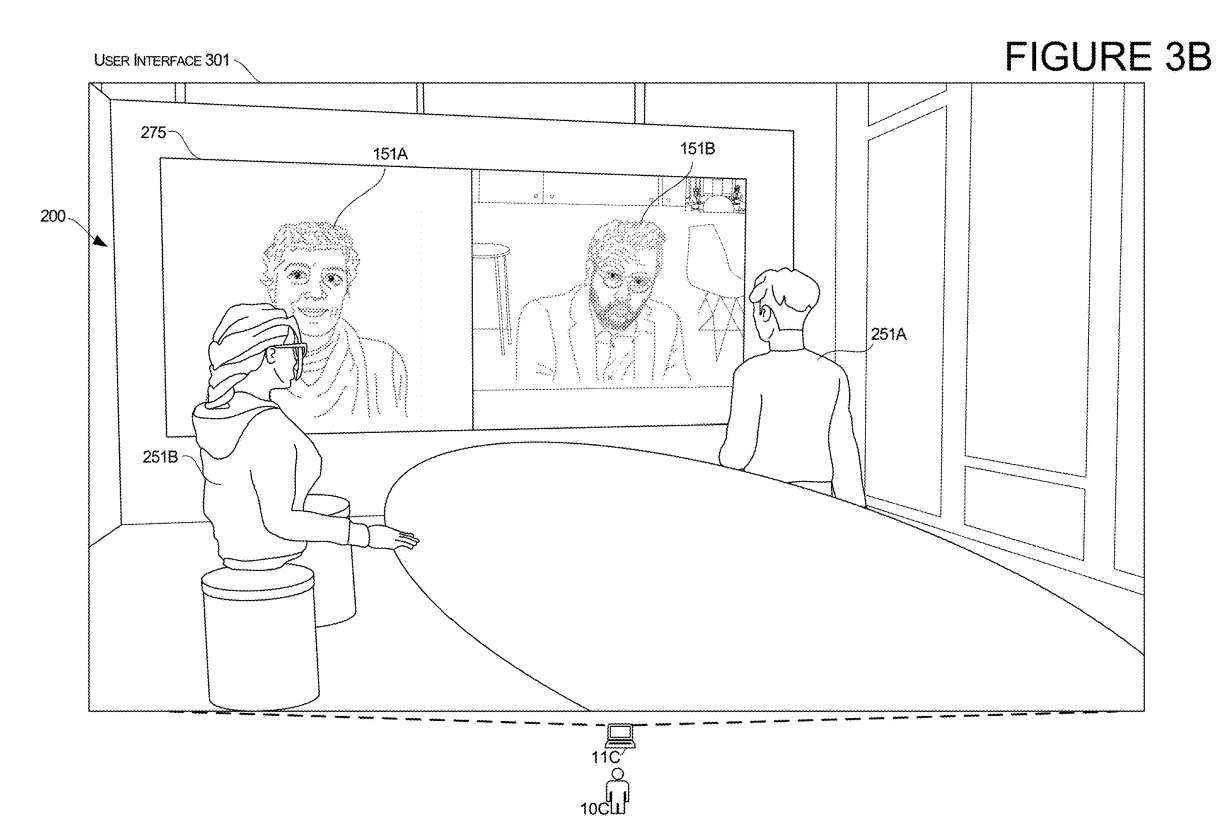

Abbildungen 3A und 3B veranschaulichen einen weiteren Aspekt der Drittbenutzerkonvertierung. In diesem Beispiel wird die Präsentation des dritten Benutzers 10C vom 2D-Modus in den 3D-Modus umgewandelt.

Wie in Abbildung 3A gezeigt, zeigt die Benutzeroberfläche 301 zunächst die zweidimensionalen Bilder von Jessamine, Lawrence und Mike an, die jeweils als Darstellungen der Bilder 151A, 151B und 151D angezeigt werden. Die Benutzeroberfläche umfasst gleichzeitig eine Darstellung der 3D-Umgebung 200 mit zwei 3D-Darstellungen 251A und 251B anderer Benutzer.

Als Reaktion auf die in diesem Artikel beschriebenen Eingabedaten führt das System Transformationen durch. Beim Übergang des dritten Benutzers wechselt der dritte Computer 11C des dritten Benutzers 10C von der in FIG. 3A gezeigten Benutzeroberfläche zu der in FIG. 3B gezeigten Benutzeroberfläche.

Nach der Konvertierung zeigt Charlottes Computer 11C die geänderte Benutzeroberfläche 301 an, wie in Abbildung 3B dargestellt. Das System verwaltet den Status jedes Benutzers, genau wie die dreidimensionale Darstellung der beiden Benutzer 251A und 251B in Abbildung 3A, und behält auch die dreidimensionale Darstellung von 251A und 251B in Abbildung 3B bei

Ebenfalls in Abbildung 3B gezeigt, umfasst die modifizierte Benutzeroberfläche 301 ein virtuelles Objekt 275, in diesem Fall ein virtuelles Anzeigegerät, das eine 2D-Wiedergabe des anderen Benutzers anzeigt, die zunächst als 2D-Bild angezeigt wird, wie in Abbildung 3A Jessamine und Lawrence .

Diese modifizierte 301-Benutzeroberfläche zeigt jetzt Charlottes Perspektive an, als ob sie sich von einer 2D-Umgebung in eine 3D-Umgebung teleportiert hätte. Ähnlich wie bei den anderen Beispielen kann das System bei dieser Teleportation die Position und Richtung des Charlotte-Avatars anhand eines oder mehrerer Faktoren bestimmen.

In einem Beispiel wie diesem bedient Charlotte möglicherweise ein Gerät, beispielsweise einen PC. Als Reaktion auf eine oder mehrere hierin beschriebene Eingaben kann das System dann von der Benutzeroberfläche aus Abbildung 3A zur Benutzeroberfläche aus Abbildung 3B wechseln, während der Desktop-PC weiterhin verwendet wird. Dieser beispielhafte Übergang kann auch ohne die Verwendung eines Headsets erreicht werden, das traditionell zum Betrachten von 3D-Renderings verwendet wird.

In einem anderen Beispiel könnte der Übergang beinhalten, dass Charlotte mit der Benutzeroberfläche von Abbildung 3B beginnt und dann zur Benutzeroberfläche von Abbildung 3A übergeht. In diesem Beispiel bedient Charlotte möglicherweise ein separates Gerät, beispielsweise ein Head-Mounted-Display. Sie navigiert zunächst durch die in Abbildung 3B gezeigte 3D-Umgebung, und dann kann das System durch Reaktion auf eine oder mehrere in diesem Artikel beschriebene Eingaben von der Benutzeroberfläche aus Abbildung 3B zur Benutzeroberfläche aus Abbildung 3A wechseln und das Headset weiterhin verwenden. Diese Beispielkonvertierung ist auch ohne Verwendung eines Computers möglich, der traditionell zum Betrachten von 2D-Bildern verwendet wird

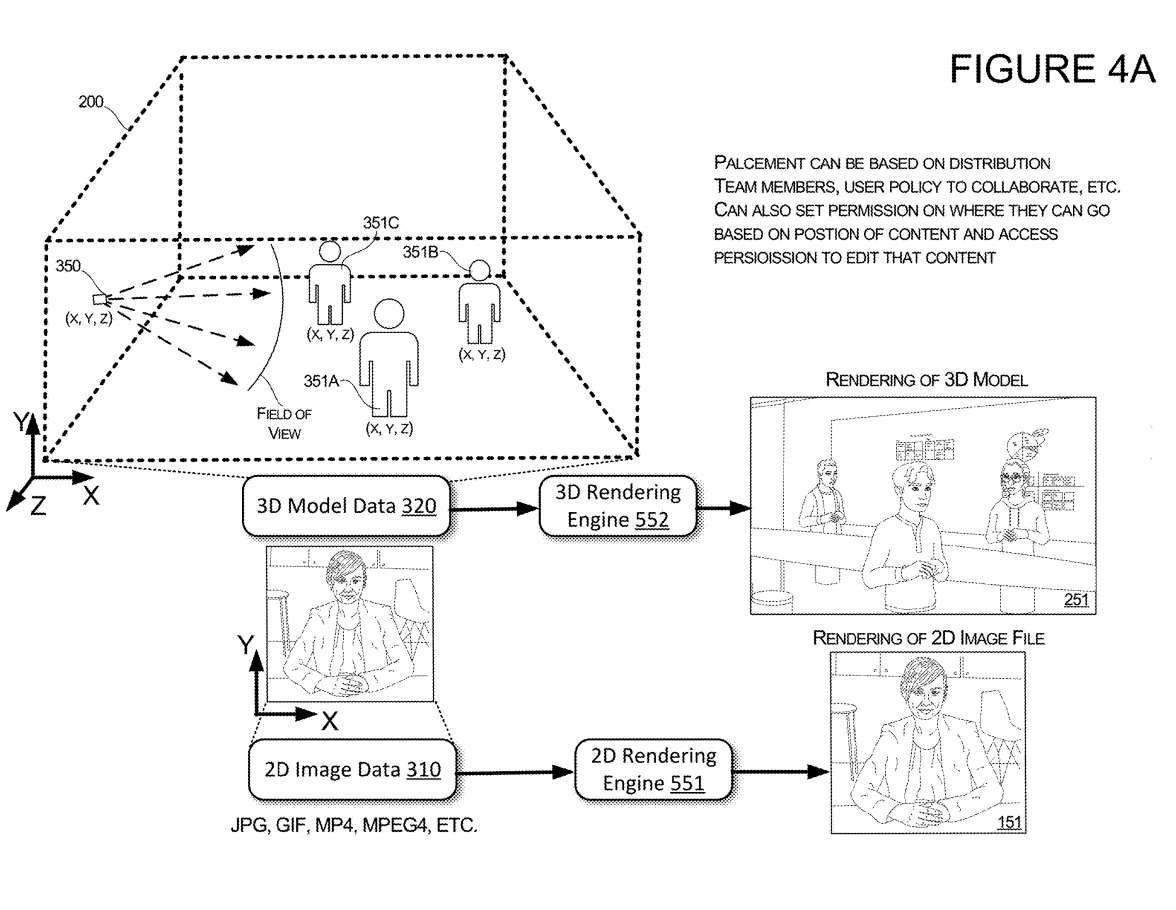

Abbildung 4A veranschaulicht weitere Merkmale von UI-Übergängen. Beim Empfang einer Eingabe, die dazu führt, dass die Benutzeroberfläche von einer Darstellung eines 2D-Bildes von Benutzer 1OC zu einer Darstellung einer 3D-Darstellung von Benutzer 1OC übergeht, kann das System die Position und Ausrichtung der 3D-Darstellung von Benutzer 1OC bestimmen.

Wenn ein Modell beispielsweise mit nur zwei virtuellen Objekten 351A und 351B beginnt, die Benutzer in der virtuellen Umgebung 200 darstellen, kann das System die Position und Richtung des neu hinzugefügten virtuellen Objekts 351C bestimmen, das den Benutzer darstellt. In diesem Beispiel kann das System, wenn die Eingabe einen bestimmten Benutzer angibt, wie z. B. den dritten Benutzer 10C, den Standort des virtuellen Objekts 351C, das den dritten Benutzer 10C darstellt, auf der Grundlage des Standorts anderer Benutzer in der virtuellen Umgebung 200 und/oder des gemeinsam genutzten Standorts bestimmen Inhalt. Ort und Richtung

Wenn das System in einem anschaulichen Beispiel feststellt, dass das virtuelle Objekt 351C, das den dritten Benutzer 10C darstellt, zur virtuellen Umgebung 200 hinzugefügt werden soll, kann das System das virtuelle Objekt 351C so positionieren, dass das virtuelle Objekt 351C für den Benutzer erscheint, den der Avatar betrachtet Inhalte, die mit Benutzer 10C geteilt wurden.

Wenn das System in einem anderen Beispiel feststellt, dass das virtuelle Objekt 351C, das einen dritten Benutzer 10C darstellt, zur virtuellen Umgebung 200 hinzugefügt werden soll, kann das System das virtuelle Objekt 351C so positionieren, dass es als Avatar-Konversation des Benutzers mit dem Benutzer erscheint 10°C

In einer Ausführungsform kann die Platzierung jedes virtuellen Objekts 351 auf der Verteilung zwischen Teammitgliedern, Benutzergruppen und/oder Richtlinien basieren, die von einzelnen Benutzern oder Benutzergruppen festgelegt wurden. Wenn beispielsweise eine Person Teil eines Unternehmensteams ist und eine von ihnen bei der Eingabe in die Transformationsbenutzeroberfläche identifiziert wird, wird ihr entsprechender Avatar innerhalb eines Schwellenabstands zu anderen Teammitgliedern positioniert.

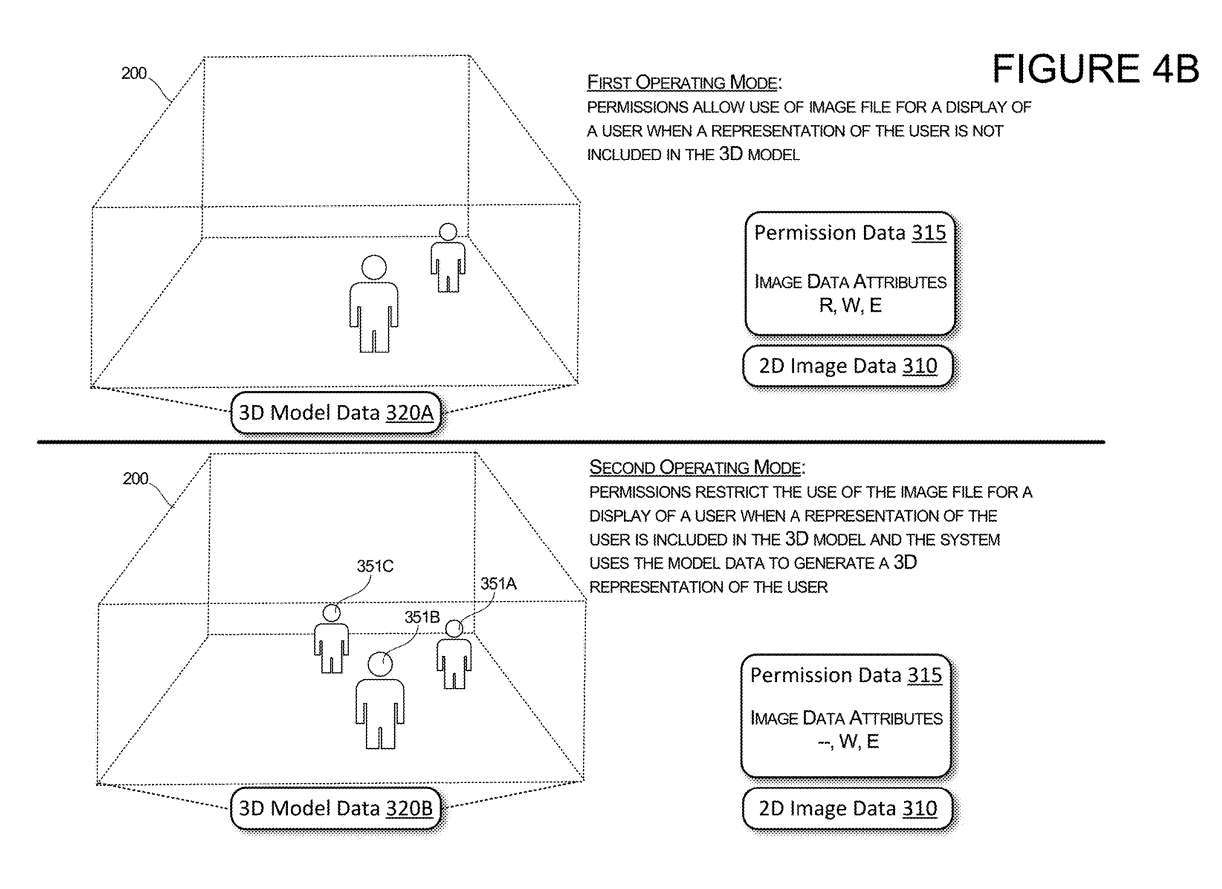

Abbildung 4B zeigt die beiden Betriebsmodi des Systems und wie jeder Betriebsmodus die Berechtigungen der an einer Kommunikationssitzung teilnehmenden Personen ändert. Wenn in einem ersten Betriebsmodus im oberen Teil von Abbildung 4B keine Darstellung des Benutzers im 3D-Modell enthalten ist, können Berechtigungen es dem System ermöglichen, eine Bilddatei zu verwenden, um ein 2D-Bild des Benutzers anzuzeigen.

In diesem Fall befinden sich die 3D-Modelldaten im ersten Zustand 320A, in dem der ausgewählte Benutzer kein virtuelles Objekt hat, das den Benutzer in der 3D-Umgebung 200 repräsentiert. Wenn sich das 3D-Modell in diesem Zustand befindet, verfügt der ausgewählte Benutzer über kein virtuelles Objekt, das diesen Benutzer in der 3D-Umgebung darstellt, und die mit dem Benutzer verknüpften Berechtigungsdaten 315 sind so konfiguriert, dass sie dem System und anderen Benutzern den Zugriff auf die Bilddaten 310 des Benutzers ermöglichen. Dies bedeutet, dass das System und der Client jedes Remote-Benutzers die Bilddaten 310 verwenden können, um die Präsentation dieses Benutzers zu erstellen, oder dass das System die Bilddaten 310 bearbeiten kann.

Wenn das System erkennt, dass sich die 3D-Modelldaten im zweiten Zustand befinden, beispielsweise wenn die Modelldaten 320B ein virtuelles Objekt 351C enthalten, das den ausgewählten Benutzer darstellt, ändert das System die Berechtigungen, um die Verwendung der Bilddaten durch den jeweiligen Benutzer einzuschränken Benutzer. Wie in der Abbildung gezeigt, ändert das System die Berechtigungsdaten 315, um das System daran zu hindern, die Bilddaten 310 zu lesen, um das 2D-Bild des bestimmten Benutzers anzuzeigen. In diesem Betriebsmodus sind die Berechtigungen so konfiguriert, dass der Zugriff auf Bilddaten auf alle Benutzer beschränkt ist und somit verhindert wird, dass alle Clients auf 2D-Bilddateien zugreifen oder diese anzeigen können

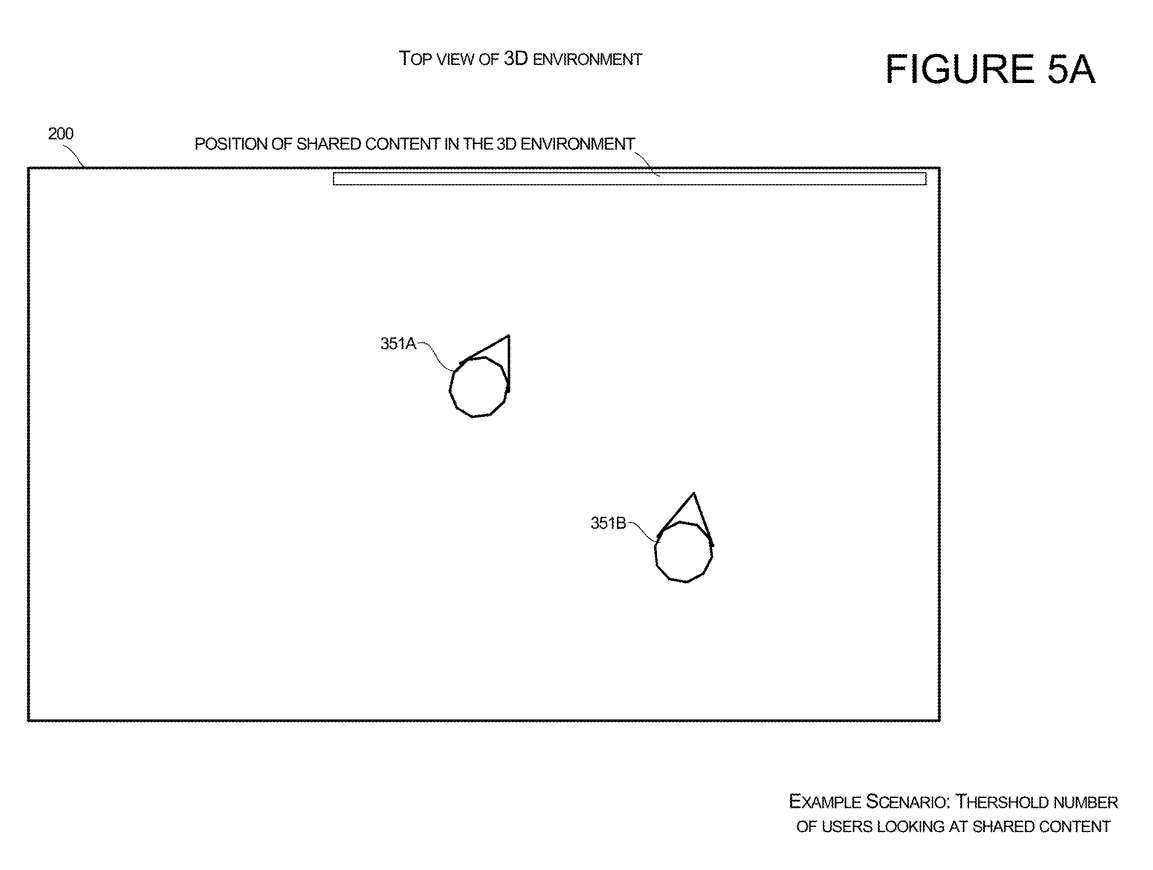

Die Abbildungen 5A und 5B veranschaulichen Merkmale eines Systems, das so konfiguriert ist, dass es die Darstellung eines Benutzers in einer 3D-Umgebung 200 relativ zu freigegebenen Inhalten lokalisiert.

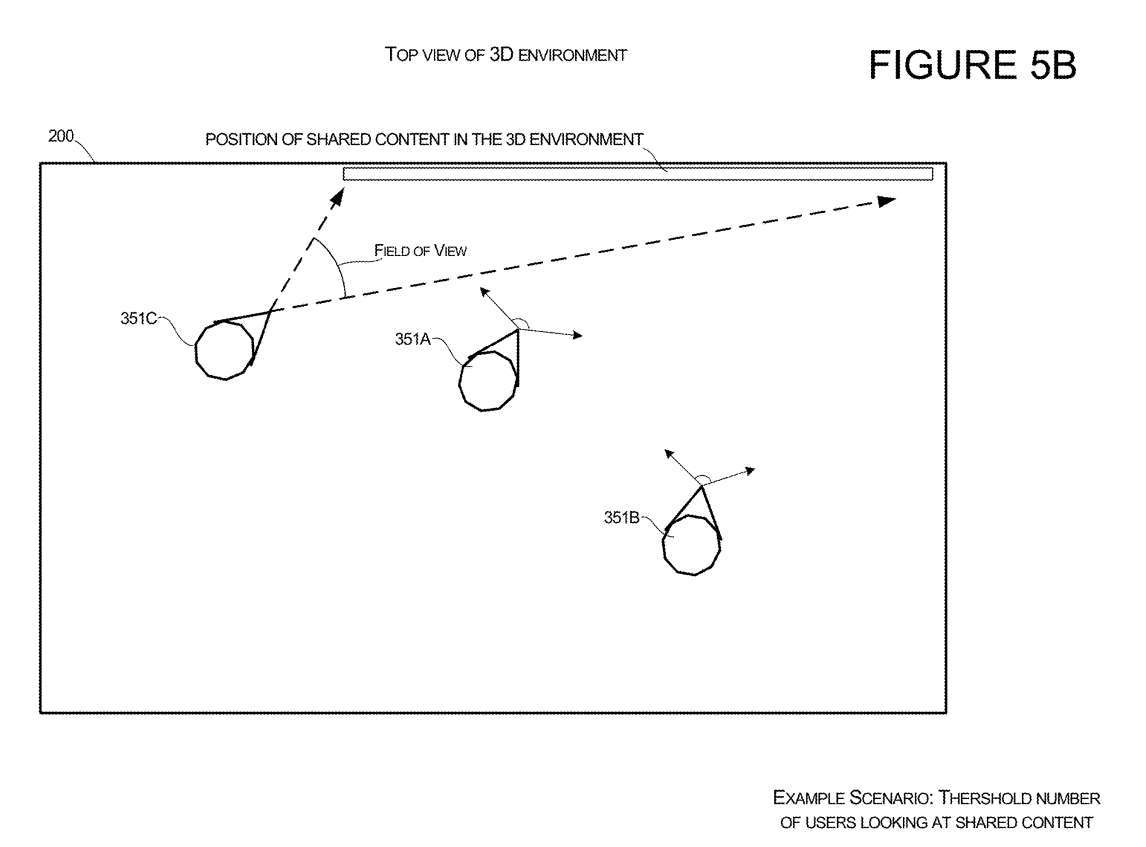

Die Avatar-Ausrichtung für einen ersten Benutzer 351A und einen zweiten Benutzer 351B ist in Abbildung 5A für ein Szenario der Anzeige gemeinsamer Inhalte in einer 3D-Umgebung dargestellt. Die von ihnen geteilten Inhalte können auf virtuellen Objekten, beispielsweise virtuellen Displays, angezeigt werden. Wenn das System erkennt, dass eine bestimmte Anzahl von Benutzern geteilte Inhalte anzeigt, generiert das System für den dritten Benutzer mit Avatar eine Wegbeschreibung in die 3D-Umgebung Ein Beispiel für die

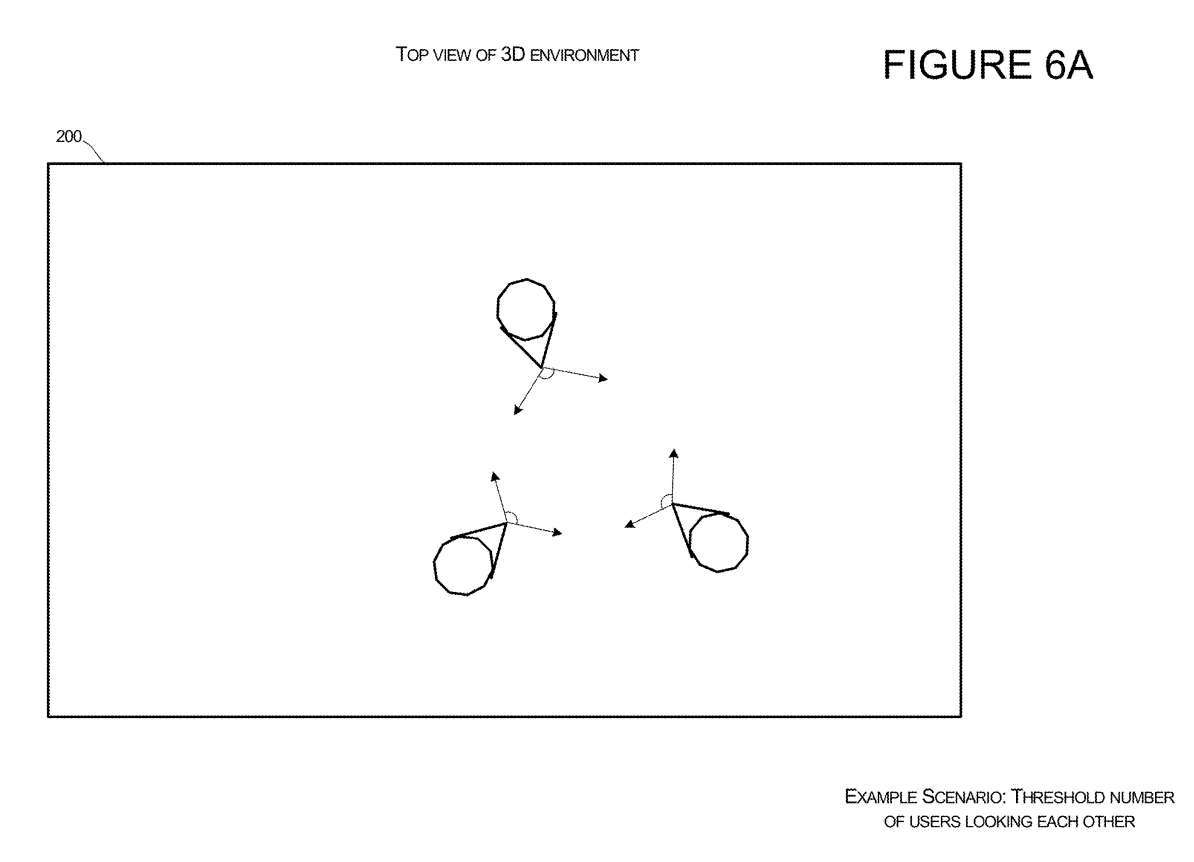

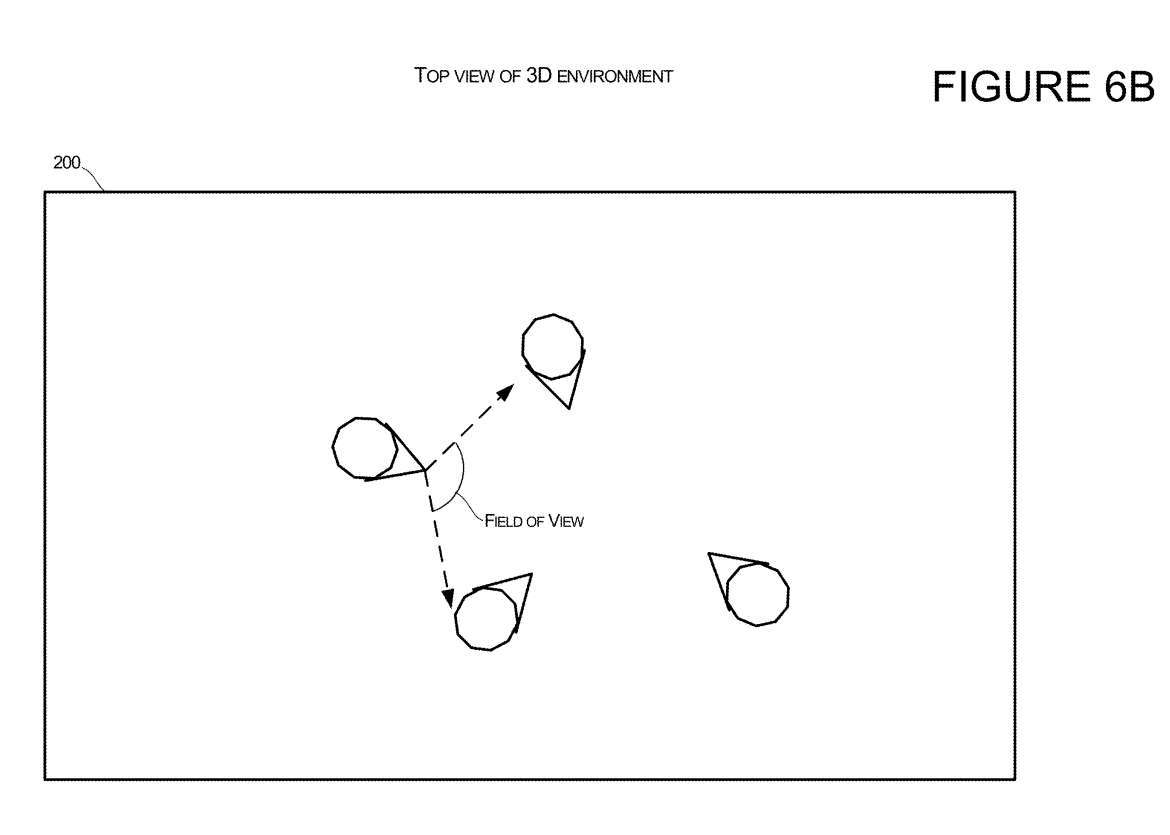

-Funktion ist in Abbildung 5B dargestellt. In diesem Beispiel wird der Avatar des dritten Benutzers 351C zur virtuellen Umgebung hinzugefügt. Der Avatar des dritten Benutzers 351C zeigt auf den geteilten Inhalt als Reaktion darauf, dass das System erkennt, dass der andere Benutzer Inhalte in seinem Sichtfeld geteilt hat. Das System kann auch die Geometrie des Sichtfelds jeder Person bestimmen und die Position des Avatars des dritten Benutzers bestimmen, sodass der Avatar des dritten Benutzers nicht die Sichtfelder anderer Benutzer blockiert.Die Abbildungen 6A und 6B veranschaulichen Konfigurationen, die so konfiguriert sind, dass sie relativ zu anderen Benutzern in einer 3D-Umgebung 200 positioniert werden. Abbildung 6A zeigt ein Szenario, in dem die Avatare eines ersten und eines zweiten Benutzers so ausgerichtet sind, dass die Benutzer einander in der virtuellen Umgebung ansehen.

Wenn das System in einem bestimmten Team oder einer vorgegebenen Gruppe feststellt, dass sich eine bestimmte Anzahl von Personen gegenseitig ansieht, kann das System den Avatar des dritten Benutzers, der die Umgebung betritt, so positionieren, dass die Position des Avatars auf andere Benutzer gerichtet ist. Abbildung 6A zeigt mehrere Avatare mit mindestens drei Benutzern und anderen Gruppenmitgliedern im Sichtfeld. Wenn das System feststellt, dass sich bei einer bestimmten Schwellenwertanzahl virtueller Charaktere andere Gruppenmitglieder im Sichtfeld befinden, wie in Abbildung 6B dargestellt, kann das System neuen Gruppenmitgliedern den Beitritt zur virtuellen Umgebung an einem Ort und einer Ausrichtung ermöglichen, die dem Benutzer dies ermöglichen andere Gruppenmitglieder anzeigen.

Verwandte Patente: Microsoft-Patent |. 2D- und 3D-Übergänge für Darstellungen von Benutzern, die an Kommunikationssitzungen teilnehmen

Die Microsoft-Patentanmeldung mit dem Titel „2D- und 3D-Übergänge für Darstellungen von Benutzern, die an Kommunikationssitzungen teilnehmen“ wurde ursprünglich im Mai 2022 eingereicht und kürzlich vom US-Patent- und Markenamt veröffentlicht.

Es ist zu beachten, dass eine US-Patentanmeldung im Allgemeinen nach der Prüfung automatisch 18 Monate nach dem Anmeldetag oder Prioritätsdatum veröffentlicht wird oder auf Antrag des Patentinhabers innerhalb von 18 Monaten nach dem Anmeldetag veröffentlicht wird Antragsteller. Beachten Sie, dass die Veröffentlichung einer Patentanmeldung nicht bedeutet, dass das Patent genehmigt wird. Nachdem eine Patentanmeldung eingereicht wurde, verlangt das USPTO eine tatsächliche Prüfung, die zwischen einem und drei Jahren dauern kann.

Das obige ist der detaillierte Inhalt vonMicrosoft-Patentfreigabe für den nahtlosen Übergang zwischen 2D und 3D in Metaverse-Remote-Meetings. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Was bedeutet das Metaverse-Konzept?

Was bedeutet das Metaverse-Konzept?

Beliebte Erklärung, was Metaverse XR bedeutet

Beliebte Erklärung, was Metaverse XR bedeutet

Was bedeutet Metaverse Concept Stock?

Was bedeutet Metaverse Concept Stock?

iexplore.exe

iexplore.exe

Verwendung der Stripslashes-Funktion

Verwendung der Stripslashes-Funktion

Was ist das World Wide Web?

Was ist das World Wide Web?

So schneiden Sie lange Bilder auf Huawei-Handys

So schneiden Sie lange Bilder auf Huawei-Handys

Wie stellen MySQL und Redis die Konsistenz beim doppelten Schreiben sicher?

Wie stellen MySQL und Redis die Konsistenz beim doppelten Schreiben sicher?