Die Aufgabe zur Generierung menschlicher Aktionen zielt darauf ab, realistische menschliche Aktionssequenzen zu generieren, um den Anforderungen von Unterhaltung, virtueller Realität, Robotik und anderen Bereichen gerecht zu werden. Herkömmliche Generierungsmethoden umfassen Schritte wie die Erstellung von 3D-Charakteren, Keyframe-Animationen und Bewegungserfassung, die viele Einschränkungen aufweisen, wie zum Beispiel, dass sie lange dauern, professionelles technisches Wissen erfordern, teure Systeme und Software erfordern und mögliche Kompatibilität zwischen verschiedenen Software- und Hardwaresystemen aufweisen. Sexuelle Probleme usw. Mit der Entwicklung des Deep Learning begann man, generative Modelle zu verwenden, um eine automatische Generierung menschlicher Aktionssequenzen zu erreichen, indem man beispielsweise Textbeschreibungen eingab und vom Modell verlangte, Aktionssequenzen zu generieren, die den Textanforderungen entsprechen. Mit der Einführung von Diffusionsmodellen in diesem Bereich verbessert sich die Konsistenz generierter Aktionen mit gegebenem Text weiter.

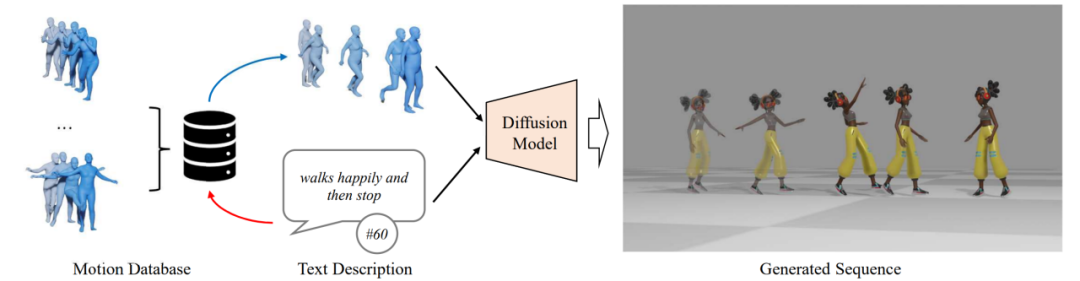

Obwohl die Natürlichkeit der generierten Aktionen verbessert wurde, besteht immer noch eine große Lücke zwischen ihr und den Benutzerbedürfnissen. Um die Fähigkeiten des Algorithmus zur Erzeugung menschlicher Bewegungen weiter zu verbessern, schlägt dieser Artikel den ReMoDiffuse-Algorithmus (Abbildung 1) basierend auf MotionDiffuse [1] vor. Mithilfe der Retrieval-Strategie finden wir hochrelevante Referenzbeispiele und stellen feinkörnige Referenzmerkmale bereit, um Aktionssequenzen höherer Qualität zu generieren

GitHub-Link: https://github.com/mingyuan-zhang/ReMoDiffuse

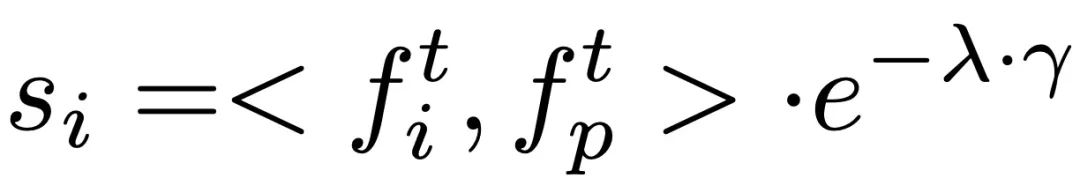

Einführung in die MethodeDer Hauptprozess von ReMoDiffuse ist in zwei Phasen unterteilt: Abruf und Diffusion. In der Abrufphase nutzt ReMoDiffuse die hybride Abruftechnologie, um informationsreiche Proben aus externen multimodalen Datenbanken abzurufen, basierend auf dem Benutzereingabetext und der erwarteten Länge der Aktionssequenz, und bietet so leistungsstarke Anleitungen für die Aktionsgenerierung. In der Diffusionsphase verwendet ReMoDiffuse die in der Abrufphase erhaltenen Informationen, um über eine effiziente Modellstruktur Bewegungssequenzen zu generieren, die semantisch mit der Benutzereingabe übereinstimmen. Um einen effizienten Abruf sicherzustellen, hat ReMoDiffuse den folgenden Datenfluss sorgfältig für den Abruf entworfen Stufe (Abbildung 2):Am Abrufprozess sind drei Arten von Daten beteiligt, nämlich Benutzereingabetext, erwartete Länge der Aktionssequenz und eine externe multimodale Datenbank mit mehrerenPaaren. Beim Abrufen der relevantesten Proben verwendet ReMoDiffuse die Formel

Einführung in die MethodeDer Hauptprozess von ReMoDiffuse ist in zwei Phasen unterteilt: Abruf und Diffusion. In der Abrufphase nutzt ReMoDiffuse die hybride Abruftechnologie, um informationsreiche Proben aus externen multimodalen Datenbanken abzurufen, basierend auf dem Benutzereingabetext und der erwarteten Länge der Aktionssequenz, und bietet so leistungsstarke Anleitungen für die Aktionsgenerierung. In der Diffusionsphase verwendet ReMoDiffuse die in der Abrufphase erhaltenen Informationen, um über eine effiziente Modellstruktur Bewegungssequenzen zu generieren, die semantisch mit der Benutzereingabe übereinstimmen. Um einen effizienten Abruf sicherzustellen, hat ReMoDiffuse den folgenden Datenfluss sorgfältig für den Abruf entworfen Stufe (Abbildung 2):Am Abrufprozess sind drei Arten von Daten beteiligt, nämlich Benutzereingabetext, erwartete Länge der Aktionssequenz und eine externe multimodale Datenbank mit mehrerenPaaren. Beim Abrufen der relevantesten Proben verwendet ReMoDiffuse die Formel

und Aktionsmerkmale. Diese beiden dienen zusammen mit den aus der Texteingabe des Benutzers extrahierten Merkmalenals Eingabesignale für die Diffusionsphase, um die Aktionsgenerierung zu steuern.

Abbildung 2: Abrufphase von ReMoDiffuse

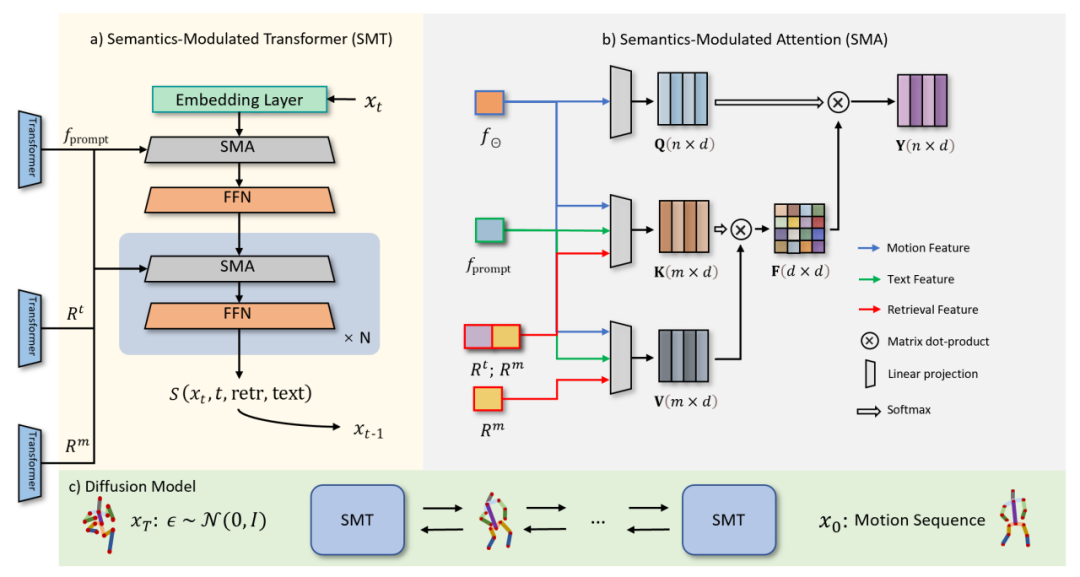

Der Diffusionsprozess (Abbildung 3.c) besteht aus zwei Teilen: dem Vorwärtsprozess und dem Rückwärtsprozess. Im Vorwärtsprozess fügt ReMoDiffuse den ursprünglichen Bewegungsdaten nach und nach Gaußsches Rauschen hinzu und wandelt es schließlich in zufälliges Rauschen um. Der umgekehrte Prozess konzentriert sich auf die Entfernung von Rauschen und die Erzeugung realistischer Bewegungsmuster. Ausgehend von einem zufälligen Gaußschen Rauschen verwendet ReMoDiffuse bei jedem Schritt des inversen Prozesses ein Semantic Modulation Module (SMT) (Abbildung 3.a), um die wahre Verteilung zu schätzen und das Rauschen basierend auf dem bedingten Signal schrittweise zu entfernen. Das SMA-Modul in SMT integriert hier alle Zustandsinformationen in die generierten Sequenzfunktionen. Dies ist das in diesem Artikel vorgeschlagene Kernmodul. Abbildung 3.b) verwenden wir den effizienten Aufmerksamkeitsmechanismus (Efficient Attention) [3], um die Berechnung des Aufmerksamkeitsmoduls zu beschleunigen und eine globale Feature-Map zu erstellen, die globale Informationen stärker hervorhebt. Diese Feature-Map liefert umfassendere semantische Hinweise für Aktionssequenzen und verbessert dadurch die Leistung des Modells. Das Hauptziel der SMA-Schicht besteht darin, die Generierung von Aktionssequenzen

durch die Aggregation von Zustandsinformationen zu optimieren. In diesem Rahmen:1.Q-Vektor stellt speziell die erwartete Aktionssequenz dar, die wir basierend auf bedingten Informationen voraussichtlich generieren werden. Der 2.K-Vektor dient als Indexierungsmechanismus, der mehrere Faktoren umfassend berücksichtigt, einschließlich aktueller Aktionssequenzmerkmale, semantischer Merkmale von Benutzereingabensowie Merkmaleund, die aus Abrufproben gewonnen wurden. Unter diesen stelltdie Aktionssequenzmerkmale dar, die aus den Abrufproben erhalten wurden, und

2.K-Vektor dient als Indexierungsmechanismus, der mehrere Faktoren umfassend berücksichtigt, einschließlich aktueller Aktionssequenzmerkmale, semantischer Merkmale von Benutzereingabensowie Merkmaleund, die aus Abrufproben gewonnen wurden. Unter diesen stelltdie Aktionssequenzmerkmale dar, die aus den Abrufproben erhalten wurden, und

3.V-Vektor stellt die tatsächlichen Funktionen bereit, die zum Generieren der Aktion erforderlich sind. Ähnlich wie der K-Vektor berücksichtigt der V-Vektor das Abrufmuster, Benutzereingaben und die aktuelle Aktionssequenz. Da keine direkte Korrelation zwischen der Textbeschreibungsfunktion des abgerufenen Beispiels und der generierten Aktion besteht, entscheiden wir uns, diese Funktion bei der Berechnung des V-Vektors nicht zu verwenden, um unnötige Informationsinterferenzen zu vermeiden

3.V-Vektor stellt die tatsächlichen Funktionen bereit, die zum Generieren der Aktion erforderlich sind. Ähnlich wie der K-Vektor berücksichtigt der V-Vektor das Abrufmuster, Benutzereingaben und die aktuelle Aktionssequenz. Da keine direkte Korrelation zwischen der Textbeschreibungsfunktion des abgerufenen Beispiels und der generierten Aktion besteht, entscheiden wir uns, diese Funktion bei der Berechnung des V-Vektors nicht zu verwenden, um unnötige Informationsinterferenzen zu vermeiden

In Kombination mit dem globalen Aufmerksamkeitsvorlagenmechanismus von Efficient Attention verwendet die SMA-Schicht die Hilfsinformationen aus dem Abrufbeispiel, die semantischen Informationen des Benutzertexts und die Merkmalsinformationen der zu entrauschenden Sequenz, um eine Reihe umfassender globaler Vorlagen zu erstellen , sodass alle Zustandsinformationen vollständig von der zu generierenden Sequenz aufgenommen werden können.

Um den Inhalt neu zu schreiben, muss der Originaltext ins Chinesische umgewandelt werden. So sieht es nach dem Umschreiben aus: Forschungsdesign und experimentelle Ergebnisse

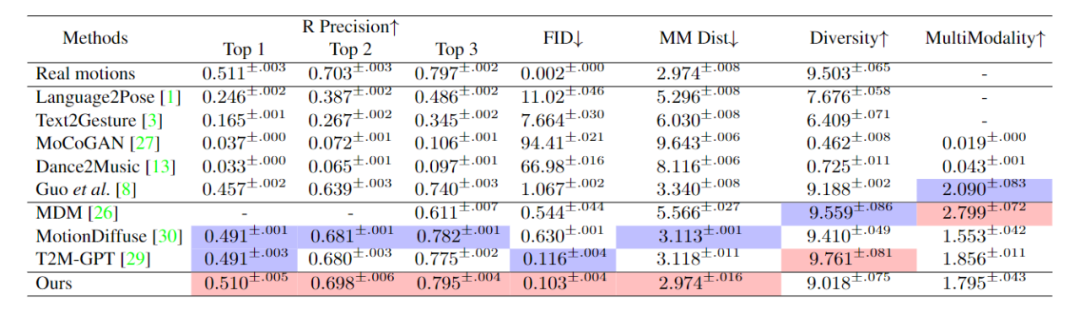

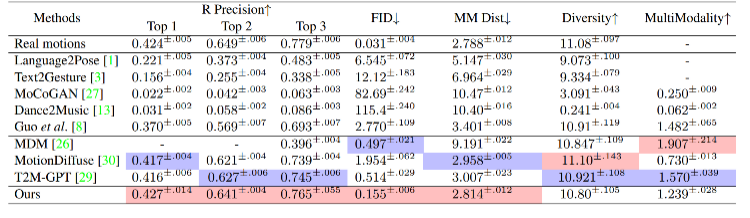

Wir haben ReMoDiffuse anhand von zwei Datensätzen evaluiert: HumanML3D [4] und KIT-ML [5]. Die experimentellen Ergebnisse (Tabellen 1 und 2) zeigen die leistungsstarke Leistung und die Vorteile unseres vorgeschlagenen ReMoDiffuse-Frameworks aus der Perspektive der Textkonsistenz und Aktionsqualität. Tabelle 1. Leistung verschiedener Methoden auf dem HumanML3D-Testsatz

Tabelle 2. Leistung verschiedener Methoden auf dem KIT-ML-Testsatz

Tabelle 2. Leistung verschiedener Methoden auf dem KIT-ML-Testsatz

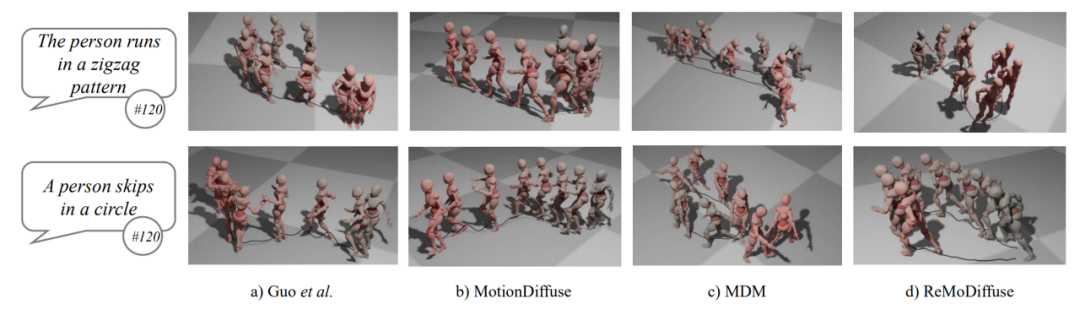

Im Folgenden finden Sie einige Beispiele, die die leistungsstarke Leistung von ReMoDiffuse zeigen (Abbildung 4). Im Vergleich zu früheren Methoden ist beispielsweise bei dem Text „Eine Person springt im Kreis“ nur ReMoDiffuse in der Lage, die „Sprung“-Bewegung und den „Kreis“-Pfad genau zu erfassen. Dies zeigt, dass ReMoDiffuse in der Lage ist, Textdetails effektiv zu erfassen und Inhalte an vorgegebene Bewegungsdauern anzupassen stellte die entsprechenden Aktionssequenzen dar, die mit der Methode von Guo et al. [4], MotionDiffuse [1], MDM [6] und ReMoDiffuse generiert wurden, und sammelte die Meinungen der Testteilnehmer in Form eines Fragebogens. Die Verteilung der Ergebnisse ist in Abbildung 5 dargestellt. Aus den Ergebnissen geht deutlich hervor, dass die Testteilnehmer in den meisten Fällen der Meinung sind, dass die von unserer Methode generierte Aktionssequenz – also die von ReMoDiffuse generierte Aktionssequenz – unter den vier Algorithmen am besten mit der gegebenen Textbeschreibung übereinstimmt ist auch am natürlichsten und geschmeidigsten. Abbildung 5: Verteilung der Benutzerbefragungsergebnisse Motiondiffuse: Textgesteuerte Erzeugung menschlicher Bewegungen basierend auf Diffusionsmodellen. arXiv-Vorabdruck arXiv:2208.15001, 2022 [2] Alec Radford, Jong Wook Kim, Chris Hallacy, Aditya Ramesh, Gabriel Goh, Sandhini Agarwal, Girish Sastry, Amanda Askell, Pamela Mishkin, Jack Clark, et al. Lernen übertragbar Visuelle Modelle aus der Überwachung natürlicher Sprache. arXiv:2103.00020, 2021.

[2] Alec Radford, Jong Wook Kim, Chris Hallacy, Aditya Ramesh, Gabriel Goh, Sandhini Agarwal, Girish Sastry, Amanda Askell, Pamela Mishkin, Jack Clark, et al. Lernen übertragbar Visuelle Modelle aus der Überwachung natürlicher Sprache. arXiv:2103.00020, 2021.

[4] Chuan Guo, Shihao Zou, Xinxin Zuo, Sen Wang, Wei Ji, Xingyu Li und Li Cheng Generieren vielfältiger und natürliche 3D-Bewegungen des Menschen aus Text. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, Seiten 5152–5161, 2022. Der Inhalt, der neu geschrieben werden muss, ist: [5] Matthias Plappert, Christian Mandery und Tamim Asfour. „Motorsprachlicher Datensatz“. Big Data, 4(4):236-252, 2016[6] Guy Tevet, Sigal Raab, Brian Gordon, Yonatan Shafir, Daniel Cohen-Or und Amit H. Bermano. In The Eleventh Internationale Konferenz über lernende Repräsentationen, 2022.

Der Inhalt, der neu geschrieben werden muss, ist: [5] Matthias Plappert, Christian Mandery und Tamim Asfour. „Motorsprachlicher Datensatz“. Big Data, 4(4):236-252, 2016[6] Guy Tevet, Sigal Raab, Brian Gordon, Yonatan Shafir, Daniel Cohen-Or und Amit H. Bermano. In The Eleventh Internationale Konferenz über lernende Repräsentationen, 2022.

Das obige ist der detaillierte Inhalt vonICCV 2023 |. ReMoDiffuse, ein neues Paradigma, das die Generierung menschlicher Handlungen neu gestaltet und Diffusionsmodelle und Abrufstrategien integriert, ist da. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!