Chatten Sie einfach mit ChatGPT und es wird Ihnen helfen, über 100.000 HuggingFace-Modelle anzurufen!

Dies sind HuggingFace Transformers Agents, die neueste Funktion von HuggingFace, die seit ihrer Einführung große Aufmerksamkeit erhalten hat:

Diese Funktion entspricht der Ausstattung großer Modelle wie ChatGPT mit „multimodalen“ Funktionen – —

Nicht auf Text beschränkt, sondern alle multimodalen Aufgaben wie Bilder, Stimmen, Dokumente usw. können gelöst werden.

Zum Beispiel könnten Sie eine Anfrage „Dieses Bild mit einer Bildunterschrift versehen“ an ChatGPT senden und ihm ein Bild eines Bibers geben. Mit ChatGPT können Sie den Bildinterpreter aufrufen und „Ein Biber schwimmt“ ausgeben das Wasser Audio: 00:0000:01

Es unterstützt nicht nur die Großmodelle von OpenAI wie ChatGPT, sondern auch andere kostenlose Großmodelle wie OpenAssistant.

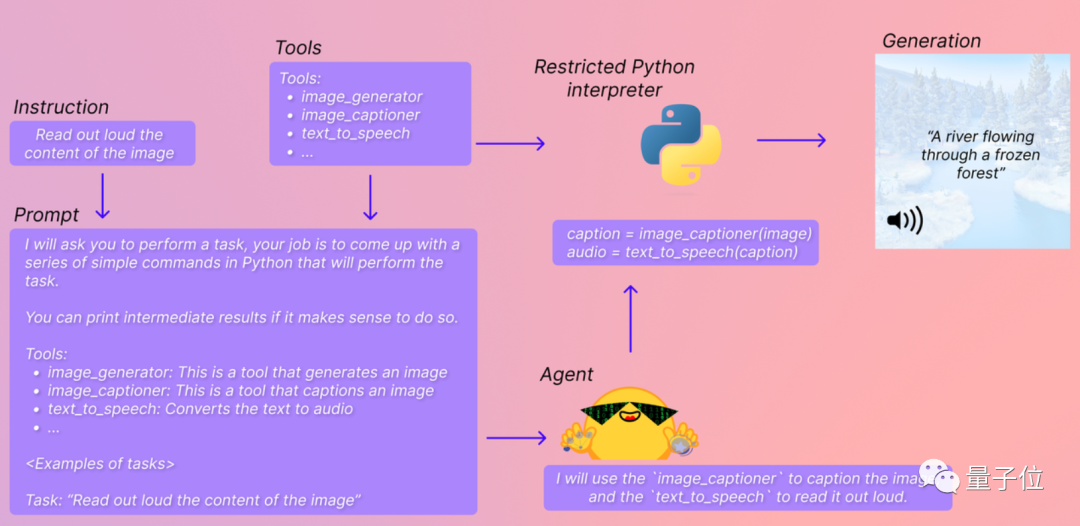

Transformer Agent ist dafür verantwortlich, diesen großen Modellen beizubringen, jedes KI-Modell direkt auf Hugging Face aufzurufen und die verarbeiteten Ergebnisse auszugeben.

Transformer Agent ist dafür verantwortlich, diesen großen Modellen beizubringen, jedes KI-Modell direkt auf Hugging Face aufzurufen und die verarbeiteten Ergebnisse auszugeben.

Auf diese Weise benötigen Sie nur einen einfachen Code + ein Eingabeaufforderungswort, und das große Modell kann Ihnen dabei helfen, das KI-Modell direkt auszuführen und die Ausgabeergebnisse in Echtzeit an Sie zurückzugeben. Der Prozess ist unterteilt in drei Schritte:

Richten Sie zunächst das große Modell ein, das Sie verwenden möchten (natürlich ist die API kostenpflichtig):

<code>from transformers import OpenAiAgentagent = OpenAiAgent(model="text-davinci-003", api_key="<your_api_key>")</your_api_key></code>

Sie können auch kostenlose große Modelle wie BigCode oder OpenAssistant verwenden :

<code>from huggingface_hub import loginlogin("<your_token>")</your_token></code> Dann richten Sie Hugging Transformers Agents ein. Hier nehmen wir den Standard-Agenten als Beispiel:

Dann richten Sie Hugging Transformers Agents ein. Hier nehmen wir den Standard-Agenten als Beispiel: <code>from transformers import HfAgent# Starcoderagent = HfAgent("https://api-inference.huggingface.co/models/bigcode/starcoder")# StarcoderBase# agent = HfAgent("https://api-inference.huggingface.co/models/bigcode/starcoderbase")# OpenAssistant# agent = HfAgent(url_endpoint="https://api-inference.huggingface.co/models/OpenAssistant/oasst-sft-4-pythia-12b-epoch-3.5")</code>Das können Sie Rufen Sie auch mehrere KI-Tools gleichzeitig auf.

Wenn Sie beispielsweise agent.run ausführen („Zeichnen Sie mir ein Bild vom Meer und verwandeln Sie das Bild dann, um eine Insel hinzuzufügen“), werden die Tools „Wen Sheng Dia“ und „Tu Sheng Dia“ aufgerufen, um Ihnen zu helfen Generieren Sie das entsprechende Bild:

chat() eignet sich zum „kontinuierlichen Erledigen von Aufgaben“ durch Chatten.

Rufen Sie zum Beispiel zuerst das Agent Chat AI-Tool auf, um ein Bild von Flüssen und Seen zu erstellen: agent.chat („Generieren Sie ein Bild von Flüssen und Seen“)

Erstellen Sie dann ein „Chart Draw“-basiertes Tool auf diesem Bild „Bild“-Modifikation: agent.chat („Transformiere das Bild so, dass dort ein Stein ist“)

Derzeit haben Transformers Agents eine Reihe von Standard-KI-Modellen integriert, die durch den Aufruf der folgenden KI-Modelle in der Transformer-Bibliothek vervollständigt werden:

1. Solange Sie eine Datei im Bildformat bereitstellen (einschließlich aus PDF konvertierter Bilder), können Sie diese zur Beantwortung von Fragen zur Datei verwenden.

Wenn Sie beispielsweise fragen: „Wo findet die Sitzung des wissenschaftlichen Beratungsausschusses der TRRF statt? Anhand eines langen Artikels und einer Frage kann es verschiedene Textfragen beantworten und Ihnen beim Leseverständnis helfen.

3. Zero-Shot-Bildsprachenmodell BLIP. Es kann den Inhalt des Bildes direkt verstehen und Textbeschreibungen für das Bild bereitstellen.

4. Multimodales Modell ViLT. Es kann Fragen in einem bestimmten Bild verstehen und beantworten,

4. Multimodales Modell ViLT. Es kann Fragen in einem bestimmten Bild verstehen und beantworten,

Diese Modelle können nicht nur einzeln aufgerufen werden, sondern können auch gemischt werden. Wenn das große Modell beispielsweise aufgefordert wird, „ein schönes Foto eines Bibers zu erstellen und zu beschreiben“, werden „Vincent Picture“ und „Picture Understanding“ aufgerufen. KI-Modelle bzw.

Wenn wir diese Standard-KI-Modelle nicht verwenden und ein nützlicheres „Tool-Integrationspaket“ einrichten möchten, können wir es natürlich auch selbst gemäß den Schritten einrichten.

Für Transformers Agents haben einige Internetnutzer auch darauf hingewiesen, dass es ein bisschen wie ein „Ersatz“ von LangChain-Agenten ist:

Für Transformers Agents haben einige Internetnutzer auch darauf hingewiesen, dass es ein bisschen wie ein „Ersatz“ von LangChain-Agenten ist:

Das obige ist der detaillierte Inhalt vonLassen Sie ChatGPT über 100.000 Open-Source-KI-Modelle aufrufen! Das neue Feature von HuggingFace boomt: Große Modelle lassen sich als multimodale KI-Werkzeuge nutzen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

ChatGPT-Registrierung

ChatGPT-Registrierung

Inländische kostenlose ChatGPT-Enzyklopädie

Inländische kostenlose ChatGPT-Enzyklopädie

So installieren Sie ChatGPT auf einem Mobiltelefon

So installieren Sie ChatGPT auf einem Mobiltelefon

Kann Chatgpt in China verwendet werden?

Kann Chatgpt in China verwendet werden?

Software zur Verschlüsselung von Mobiltelefonen

Software zur Verschlüsselung von Mobiltelefonen

Was soll ich tun, wenn das Webvideo nicht geöffnet werden kann?

Was soll ich tun, wenn das Webvideo nicht geöffnet werden kann?

Was ist ein Servomotor?

Was ist ein Servomotor?

Was soll ich tun, wenn der IE-Browser einen Skriptfehler auslöst?

Was soll ich tun, wenn der IE-Browser einen Skriptfehler auslöst?