Dieser Artikel stammt von Lei Feng.com. Wenn Sie ihn erneut drucken möchten, besuchen Sie bitte die offizielle Website von Lei Feng.com, um eine Genehmigung zu beantragen.

Cerebras, ein Unternehmen, das für die Entwicklung des weltweit größten Beschleunigerchips CS-2 Wafer Scale Engine bekannt ist, gab gestern bekannt, dass es einen wichtigen Schritt bei der Verwendung von „Riesenkernen“ für das Training künstlicher Intelligenz unternommen hat. Das Unternehmen hat das weltweit größte NLP-KI-Modell (Natural Language Processing) auf einem einzigen Chip trainiert.

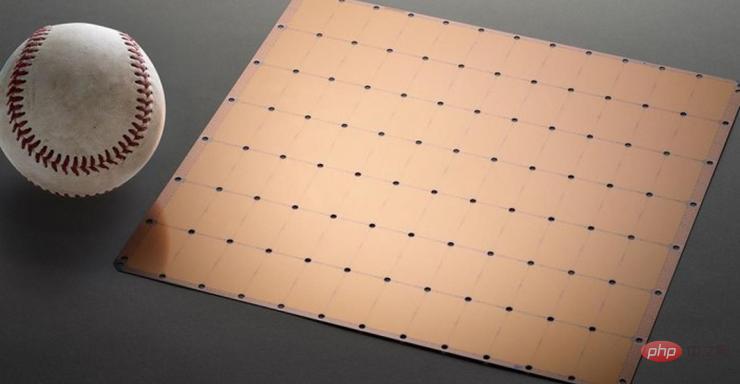

Das Modell verfügt über 2 Milliarden Parameter und wird auf dem CS-2-Chip trainiert. Der weltweit größte Beschleunigerchip verwendet einen 7-nm-Prozess und wird aus einem quadratischen Wafer geätzt. Er ist hundertmal größer als gängige Chips und hat eine Leistung von 15 kW. Es integriert 2,6 Billionen 7-nm-Transistoren, verfügt über 850.000 Kerne und 40 GB Speicher.

Abbildung 1 CS-2 Wafer Scale Engine-Chip

Die Entwicklung von NLP-Modellen ist ein wichtiges Feld der künstlichen Intelligenz. Mithilfe von NLP-Modellen kann künstliche Intelligenz die Bedeutung von Texten „verstehen“ und entsprechende Maßnahmen ergreifen. Das DALL.E-Modell von OpenAI ist ein typisches NLP-Modell. Dieses Modell kann von Benutzern eingegebene Textinformationen in Bildausgaben umwandeln.

Wenn ein Benutzer beispielsweise „Sessel in Avocadoform“ betritt, generiert die KI automatisch mehrere Bilder, die diesem Satz entsprechen.

Bild: Das von der KI nach Erhalt von Informationen generierte Bild „Avocado-förmiger Sessel“

Darüber hinaus kann dieses Modell es der KI auch ermöglichen, komplexes Wissen wie Arten, Geometrie, historische Epochen, usw.

Aber es ist nicht einfach, dies alles zu erreichen. Die traditionelle Entwicklung von NLP-Modellen weist extrem hohe Rechenleistungskosten und technische Schwellenwerte auf.

Wenn wir nur über Zahlen sprechen, scheinen die 2 Milliarden Parameter des von Cerebras entwickelten Modells im Vergleich zu seinen Mitbewerbern etwas mittelmäßig zu sein.

Das zuvor erwähnte DALL.E-Modell verfügt über 12 Milliarden Parameter, und das derzeit größte Modell ist Gopher, das Ende letzten Jahres von DeepMind eingeführt wurde, mit 280 Milliarden Parametern.

Aber abgesehen von den erstaunlichen Zahlen hat das von Cerebras entwickelte NLP einen großen Durchbruch: Es verringert die Schwierigkeit, NLP-Modelle zu entwickeln.

Nach dem traditionellen Prozess erfordert die Entwicklung von NLP-Modellen, dass Entwickler riesige NLP-Modelle in mehrere funktionale Teile aufteilen und ihre Arbeitslast auf Hunderte oder Tausende von Grafikverarbeitungseinheiten verteilen.

Tausende Grafikprozessoren bedeuten enorme Kosten für Hersteller.

Technische Schwierigkeiten machen den Herstellern auch zu schaffen.

Das Aufteilen von Modellen ist ein individuelles Problem. Die Spezifikationen jedes neuronalen Netzwerks, jeder GPU und des Netzwerks, das sie miteinander verbindet (oder miteinander verbindet), sind einzigartig und nicht systemübergreifend übertragbar.

Hersteller müssen all diese Faktoren vor der ersten Schulung klar berücksichtigen.

Diese Arbeit ist äußerst komplex und dauert teilweise mehrere Monate.

Cerebras sagte, dies sei „einer der schmerzhaftesten Aspekte“ des NLP-Modelltrainings. Nur eine Handvoll Unternehmen verfügen über die notwendigen Ressourcen und Fachkenntnisse, um NLP zu entwickeln. Für andere Unternehmen in der KI-Branche sind NLP-Schulungen zu teuer, zeitaufwändig und nicht verfügbar.

Aber wenn ein einzelner Chip ein Modell mit 2 Milliarden Parametern unterstützen kann, bedeutet das, dass keine Notwendigkeit besteht, riesige GPUs zu verwenden, um den Arbeitsaufwand für das Training des Modells zu verteilen. Dadurch können Hersteller Tausende von GPU-Schulungskosten und damit verbundene Hardware- und Skalierungsanforderungen einsparen. Es erspart den Anbietern außerdem die mühsame Aufteilung von Modellen und die Verteilung ihrer Arbeitslasten auf Tausende von GPUs.

Cerebras ist nicht nur von Zahlen besessen, um die Qualität eines Modells zu bewerten, ist die Anzahl der Parameter nicht das einzige Kriterium.

Anstatt auf die „harte Arbeit“ des im „Riesenkern“ geborenen Modells zu hoffen, hofft Cerebras, dass das Modell „intelligent“ sein wird.

Der Grund, warum Cerebras ein explosionsartiges Wachstum der Anzahl von Parametern erreichen kann, liegt darin, dass es die Weighted-Flow-Technologie verwendet. Diese Technologie entkoppelt den Rechen- und Speicherbedarf und ermöglicht die Erweiterung des Speichers, sodass er groß genug ist, um eine beliebige Anzahl von Parametern zu speichern, die bei der KI-Arbeitslast zunehmen.

Dank dieses Durchbruchs konnte die Zeit zum Einrichten eines Modells von Monaten auf Minuten verkürzt werden. Und Entwickler können mit „nur wenigen Tastendrücken“ zwischen Modellen wie GPT-J und GPT-Neo wechseln. Dies erleichtert die NLP-Entwicklung.

Dies hat zu neuen Veränderungen im Bereich NLP geführt.

Dan Olds, Chief Research Officer von Intersect360 Research, kommentierte die Erfolge von Cerebras: „Die Fähigkeit von Cerebras, große Sprachmodelle auf kostengünstige und zugängliche Weise der breiten Masse zugänglich zu machen, eröffnet eine aufregende neue Ära der künstlichen Intelligenz.“

Das obige ist der detaillierte Inhalt vonDer weltweit größte KI-Chip bricht den Rekord für das Single-Device-Training großer Modelle, Cerebras will GPUs „töten'.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!