Mehr und mehr Arbeiten haben gezeigt, dass vorab trainierte Sprachmodelle (PLM) umfangreiches Wissen enthalten. Für verschiedene Aufgaben kann die Verwendung geeigneter Trainingsmethoden zur Nutzung von PLM die Modellfähigkeiten besser verbessern. Bei Text-to-SQL-Aufgaben basieren die aktuellen Mainstream-Generatoren auf Syntaxbäumen und müssen für die SQL-Syntax entworfen werden.

Kürzlich hat sich das NetEase Interactive Entertainment AI Lab mit der Guangdong University of Foreign Studies und der Columbia University zusammengetan, um eine zweistufige Multitasking-Vortrainingsmethode basierend auf dem vorzuschlagen Vorab trainiertes Sprachmodell T5. Trainieren Sie das Modell MIGA. MIGA führt in der Vortrainingsphase drei Hilfsaufgaben ein und organisiert sie in einem einheitlichen Generierungsaufgabenparadigma, das alle Text-to-SQL-Datensätze gleichzeitig einheitlich trainieren kann. In der Feinabstimmungsphase zielt MIGA auf Fehler ab Mehrere Dialogrunden Das Übertragungsproblem wird für SQL-Störungen verwendet, was die Robustheit der Modellgenerierung verbessert.

Derzeit ist die Mainstream-Methode für die Text-to-SQL-Forschung hauptsächlich das auf dem SQL-Syntaxbaum basierende Encoder-Decoder-Modell, das sicherstellen kann, dass die generierten Ergebnisse vorhanden sein müssen entspricht der SQL-Syntax, erfordert jedoch ein spezielles Design für die SQL-Syntax. Es gibt auch einige aktuelle Forschungen zu Text-to-SQL, die auf generativen Sprachmodellen basieren, die das Wissen und die Fähigkeiten vorab trainierter Sprachmodelle leicht erben können.

Um die Abhängigkeit von Syntaxbäumen zu verringern und die Fähigkeiten vorab trainierter Sprachmodelle besser zu nutzen, wurde in dieser Studie ein vorab trainiertes T5-Modell im Rahmen von vorgeschlagen Zweistufiges Multitasking-Text-to-SQL-Vortrainingsmodell MIGA (MultI-task Ggeneration fr#🎜 🎜#Amework).

MIGA ist in zwei Phasen des Trainingsprozesses unterteilt:

Das MIGA-Modell übertrifft die derzeit besten syntaxbaumbasierten Modelle in zwei öffentlichen Text-to-SQL-Datensätzen mit Multiturn-Dialog. Relevante Untersuchungen wurden durchgeführt akzeptiert von AAAI 2023.

Papieradresse: https://arxiv.org/abs/2212.09278

MIGA-MODELLDETAILS

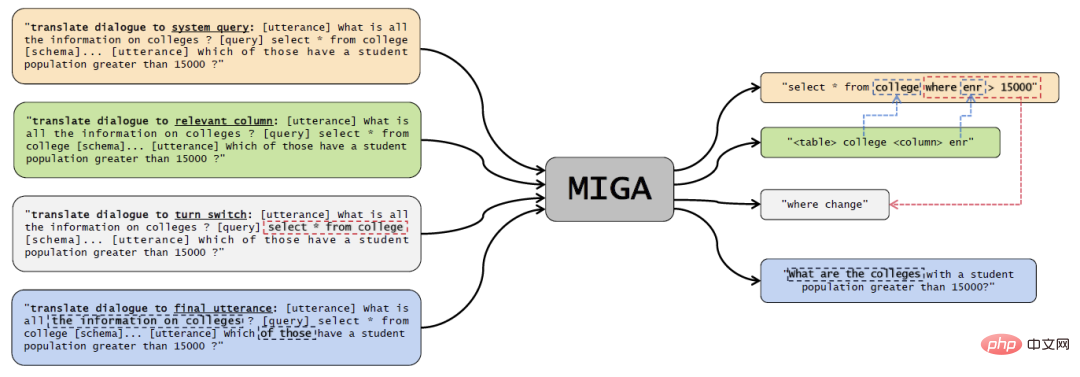

# 🎜 🎜#Abbildung 1 MIGA-Modelldiagramm.

Multitasking-Vortrainingsphase#🎜🎜 #Die Forschung bezieht sich hauptsächlich auf die Vortrainingsmethode von T5. Basierend auf dem bereits trainierten T5-Modell werden vier Vortrainingsaufgaben entworfen:

Durch ein solches einheitliches Trainingsmethodendesign kann MIGA vielseitig und flexibel sein, um aufgabenbezogenere Zusatzaufgaben zu bewältigen, und es bietet außerdem die folgenden Vorteile:

In der Vortrainingsphase integrierte die Studie Daten aus dem Text-to-SQL-Datensatz Spider und dem konversationsfähigen Text-to-SQL-Datensatz SparC und CoSQL, um das T5-Modell zu trainieren.

Feinabstimmungsphase

Nach der Vortrainingsphase verwendet diese Studie einfach Text-to-SQL-Aufgaben, um das Modell basierend auf den annotierten Daten der Zielaufgabe weiter zu verfeinern. Bei der Vorhersage der aktuellen SQL-Runde wird in dieser Studie die vorhergesagte SQL der vorherigen Runde gespleißt. Um das durch mehrere Dialog- und Generierungsrunden verursachte Fehlerübertragungsproblem zu überwinden, schlägt diese Studie ein SQL-Störungsschema vor ., stören Sie die historischen Runden von SQL in den Eingabedaten mit α-Wahrscheinlichkeit. Die Störung der SQL-Anweisung tastet hauptsächlich das entsprechende Token mit einer Wahrscheinlichkeit von β ab und führt dann eine der folgenden Störungen durch:

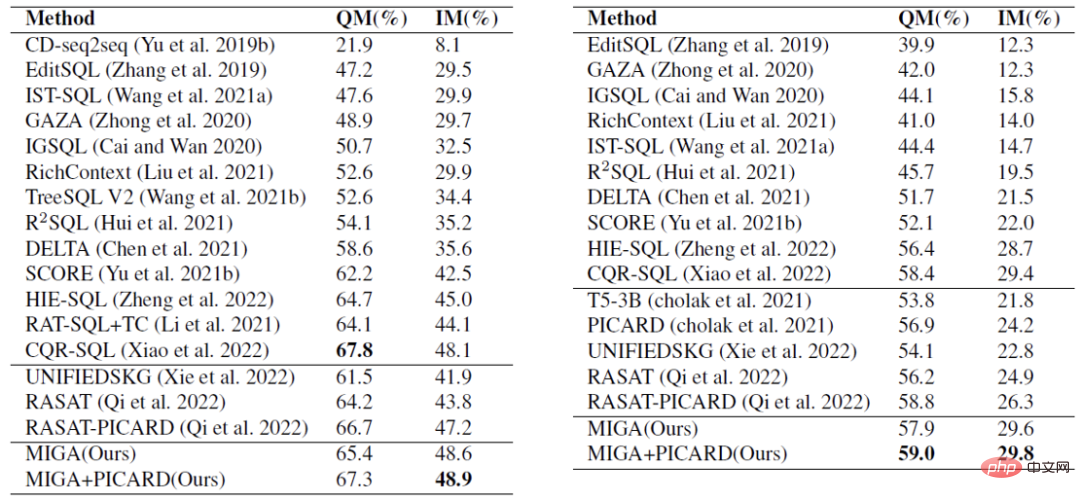

Auswertungsdatensatz für Multi-Turn-Gespräche Text-to-SQL: SparC und CoSQL.

Die Bewertungsindikatoren sind:

QM: Fragenübereinstimmung, die den Anteil des generierten SQL angibt, der in einer einzelnen Fragerunde vollständig mit der Anmerkungsausgabe übereinstimmt;

Tabelle 1 Vergleichende experimentelle Analyse, der erste Teil ist das Baummodell und der zweite Teil ist das generative Modell basierend auf dem Vortraining.

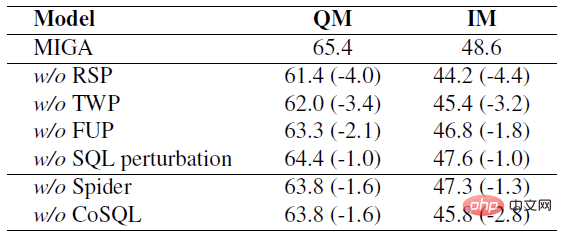

Im Ablationsexperiment in Tabelle 2 untersuchte diese Studie mehrere Aufgaben im zweistufigen Trainingsprozess von MIGA und bewies auch, dass diese Aufgaben die Zielaufgabe in unterschiedlichem Maße verbessern.

Tabelle 2 Für die SparC-Aufgabe hat das Entfernen jeder Aufgabe bzw. jeder Daten die Indikatoren reduziert.

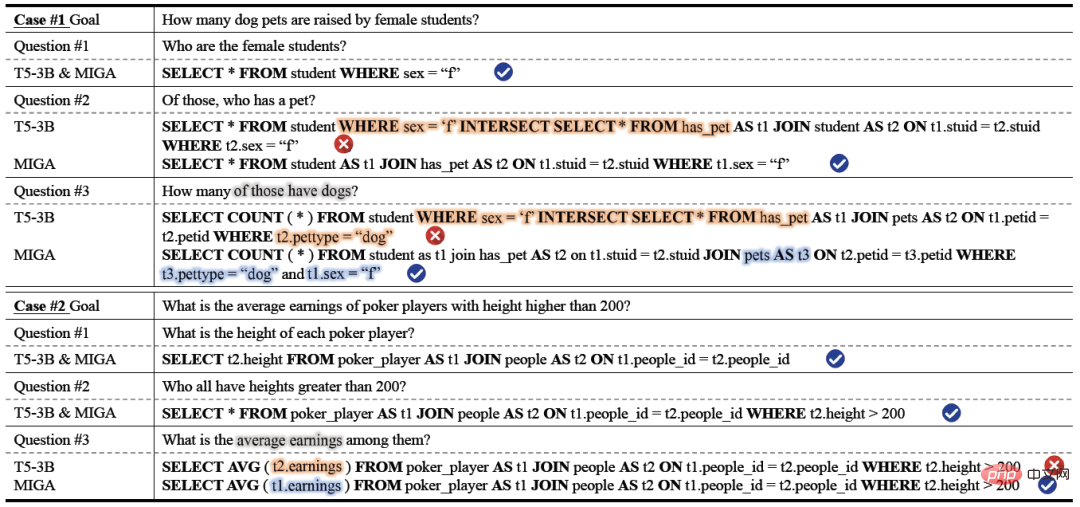

In den tatsächlichen Fallanalyseergebnissen ist die Stabilität und Korrektheit der MIGA-Generierung besser als beim auf T5-3B basierenden Trainingsmodell. Es ist ersichtlich, dass MIGA bei Verbindungsoperationen mit mehreren Tabellen und der Zuordnung von Spalten besser ist und Tische. Besser als andere Modelle. In Frage Nr. 2 von Fall Nr. 1 kann das T5-3B-Modell kein effektives SQL für die relativ komplexe JOIN-Struktur (Zwei-Tabellen-Verbindung) generieren, was zu falschen Vorhersagen für die komplexere JOIN-Struktur (Drei-Tabellen-Verbindung) in Frage führt #3. . MIGA sagt die JOIN-Struktur genau voraus und behält die vorherige Bedingung t1.sex="f" gut bei. In Fall Nr. 2 verwechselt T5-3B mehrere Spalten aus verschiedenen Tabellen und verwechselt Einnahmen mit einer Spalte der Personentabelle, während MIGA diese Spalte korrekt als zur Poker_player-Tabelle gehörend identifiziert und sie mit t1 verknüpft.

Tabelle 3 Fallanalyse.

NetEase Interactive Entertainment AI Lab schlug ein zweistufiges Multitasking-Pre-Training-Modell basierend auf T5 für Text-to-SQL vor: MIGA. In der Vortrainingsphase zerlegt MIGA die Text-to-SQL-Aufgabe in drei zusätzliche Unteraufgaben und vereinheitlicht sie in einem Sequenz-zu-Sequenz-Generierungsparadigma, um das vorab trainierte T5-Modell besser zu motivieren. Und in der Feinabstimmungsphase wird ein SQL-Störungsmechanismus eingeführt, um die Auswirkungen der Fehlerübertragung in mehreren Runden von Text-to-SQL-Generierungsszenarien zu reduzieren.

In Zukunft wird das Forschungsteam weitere effektivere Strategien erforschen, um die Leistungsfähigkeit sehr großer Sprachmodelle zu nutzen, und elegantere und effektivere Wege erkunden, um das Problem der verringerten Leistung aufgrund falscher Übertragung weiter zu überwinden.

Das obige ist der detaillierte Inhalt vonZweistufiges Multitasking-Text-to-SQL-Pre-Training-Modell MIGA basierend auf T5. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Einführung in Architekturzeichnungssoftware

Einführung in Architekturzeichnungssoftware

Welche Programme können mit PHP entwickelt werden?

Welche Programme können mit PHP entwickelt werden?

WeChat-Schritte

WeChat-Schritte

So lösen Sie das Problem der langsamen Übertragung von Serverdomänennamen

So lösen Sie das Problem der langsamen Übertragung von Serverdomänennamen

vscode führt die C-Sprache aus

vscode führt die C-Sprache aus

Methode zum Öffnen der Bereichsberechtigung

Methode zum Öffnen der Bereichsberechtigung

So stellen Sie dauerhaft gelöschte Dateien auf dem Computer wieder her

So stellen Sie dauerhaft gelöschte Dateien auf dem Computer wieder her

Was ist Maschinensprache?

Was ist Maschinensprache?