Derzeit werden künstliche Intelligenz und Deep-Learning-Technologie zu einer wichtigen Grundlage für die Text-Bild-Generierung, Superauflösung und andere Anwendungen.

Jetzt kann man eine detaillierte Beschreibung eines Bildes eingeben, um ein realistisches Bild zu erhalten, das dem angegebenen Text entspricht.

Sie können ein Bild auch von einer niedrigen Auflösung in eine hohe Auflösung konvertieren, um eine Reihe lebendiger Details für das Bild zu erzeugen.

Neuronale Netze scheinen endlose Möglichkeiten zu haben. Können diese Methoden also für Zeitreisen verwendet werden?

Haben Sie sich zum Beispiel jemals gefragt, wie ein Bild von sich selbst aussehen würde, wenn es vor fünfzig oder hundert Jahren aufgenommen worden wäre? Wie würde Ihr Lieblingsschauspieler oder Ihre Lieblingsschauspielerin aussehen, wenn sie in einer völlig anderen Zeit geboren wären als sie?

Zeitreise Schritt eins: Lösen Sie die Datensatz-Herausforderung

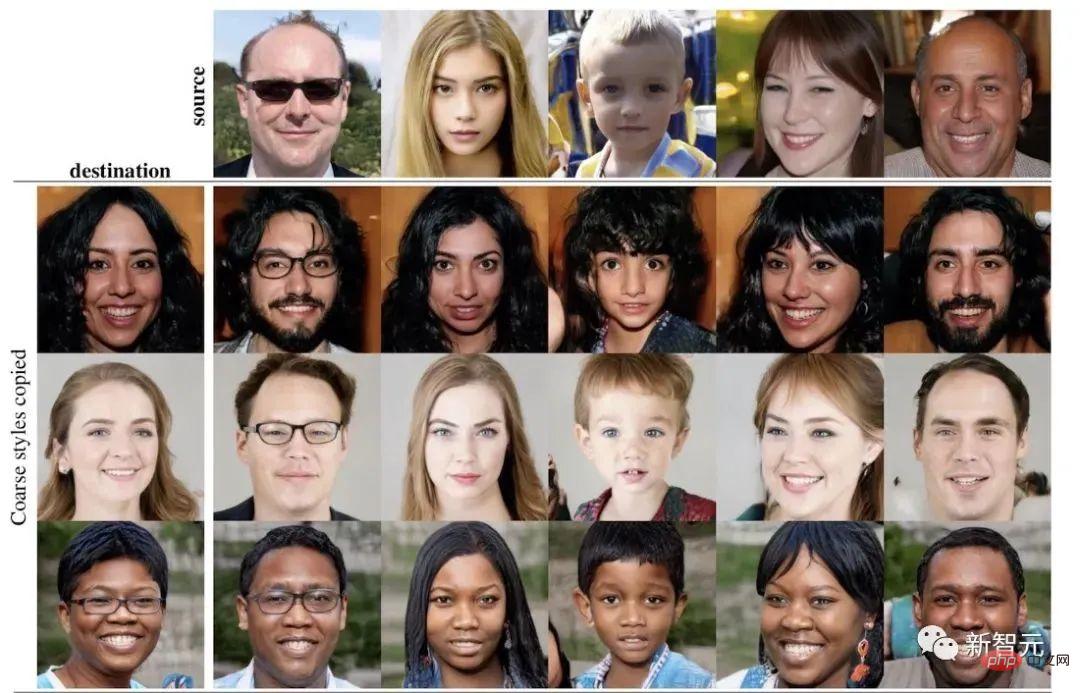

Angesichts des jüngsten Erfolgs von StyleGAN bei der hochwertigen Gesichtssynthese und -bearbeitung haben sich viele Arbeiten auf die Verwendung vorab trainierter StyleGAN-Modelle für die Porträtbearbeitung konzentriert.

Bestehende Techniken befassen sich jedoch in der Regel mit wohldefinierten semantischen Eigenschaften. Fügen Sie beispielsweise ein Lächeln hinzu oder entfernen Sie es oder ändern Sie das Alter einer Person auf einem Bild.

Die Logik hinter dieser Arbeit besteht darin, diese Attribute, die die Identität einer Person ausmachen, unverändert beizubehalten und sie gleichzeitig mithilfe dieser künstlichen Intelligenz in die Vergangenheit oder in die Zukunft zurückzuschicken.

In diesem Fall ist das Hauptproblem der Menschen der Mangel an geeigneten Datensätzen. Wie wir alle wissen, sind Datensätze selbst mit einem perfekten neuronalen Netzwerkmodell immer noch ein Albtraum für jeden Forscher im Bereich der künstlichen Intelligenz.

Unausgewogene, unzureichende oder nicht verfügbare Daten sind häufige Probleme im Bereich Deep Learning, die zu Datenverzerrungen oder ungenauen Ergebnissen führen können.

Um dieses Problem zu lösen, hat ein Forschungsteam unter der Leitung von Eric Ming Chen (2. von links), einem chinesischen Wissenschaftler der Cornell University, den FTT-Datensatz (Face Through Time) erstellt.

Chen hat gemeinsam mit dem chinesischen Wissenschaftler Jin Sun von der University of Georgia und anderen eine Publikation veröffentlicht, in der das Funktionsprinzip des „Face Through Time“-Datensatzes ausführlich erläutert wird.

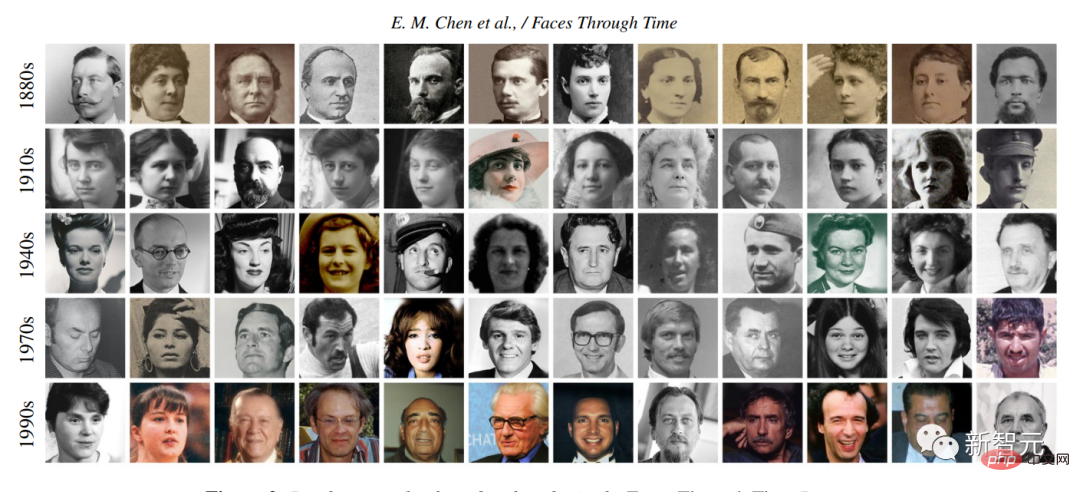

Die Bilder in diesem Datensatz stammen von Wikimedia Commons. Die Plattform bietet fünfzig Millionen Bilder, die durch Crowdsourcing und offene Lizenzen erstellt wurden. FTT analysierte 26.247 Porträts aus dem 19. bis 21. Jahrhundert, durchschnittlich etwa 1.900 Bilder pro Jahrzehnt.

Wie werden diese Veränderungen erreicht?

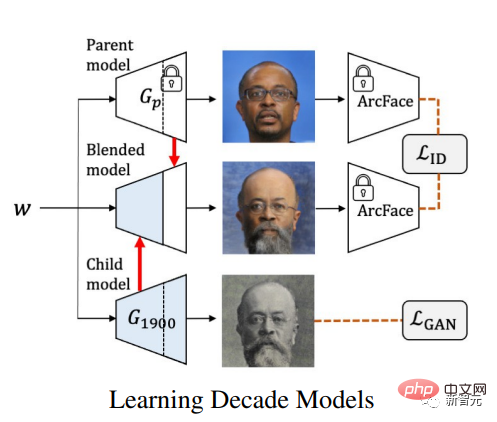

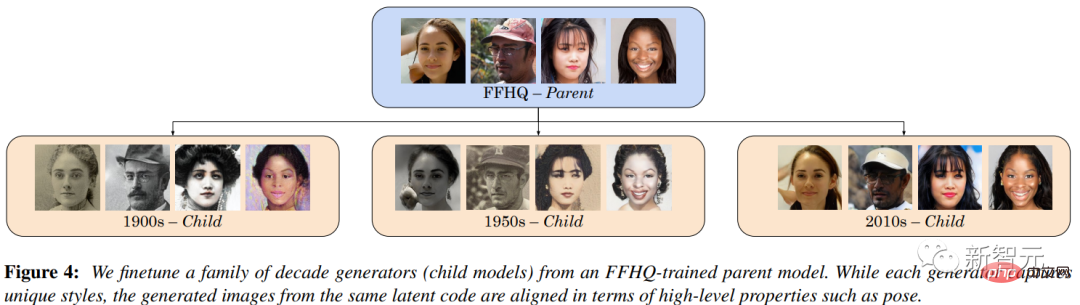

Das Forschungsteam stützte sich auf die Eltern-Kind-Hierarchie StyleGAN (Generative Adversarial Network). Das Besondere daran ist, dass sie sich nicht dafür entschieden haben, ein einzelnes Modell zu trainieren, das alle Jahrzehnte abdeckt, sondern stattdessen für jedes Jahrzehnt von Bildsätzen ein Untermodell hinzugefügt haben, um den Modellsatz zu trainieren, um die Datenverteilung jeder Periode besser zu synthetisieren.

Um gleichzeitig die Identität und Körperhaltung der beschriebenen Person zu bewahren, nutzt das Forschungsteam ein Elternmodell, um diese Informationen in latente Raumvektoren abzubilden.

Trainieren Sie zunächst einen StyleGAN-Modellsatz, einen für jede Generation, und verwenden Sie gegnerischen Verlust und Identitätsverlust, um ein gemischtes Gesichtsbild zu trainieren. Diese Gesichtskarte ist die Ausgabe des untergeordneten Modells und wurde geändert, sodass die gemischte Karte ähnliche Farben wie das übergeordnete Modell aufweist.

Das Forschungsteam schlägt vor, dass es während dieses Prozesses notwendig ist, Inkonsistenzen beim Identitätsverlust aufgrund der Merkmalsberechnung in ArcFace, einem beliebten Gesichtserkennungsmodell, zu vermeiden. Da das ArcFace-Modell nur auf modernen Bildern trainiert wurde, stellten die Forscher fest, dass es bei historischen Bildern schlecht abschnitt.

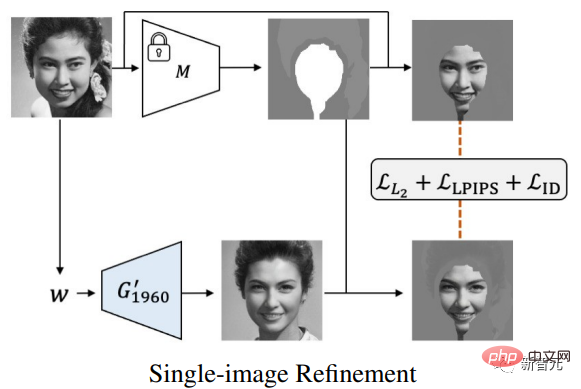

Danach wird jedes reale Bild auf einen Vektor w auf der Dekadenmannigfaltigkeit projiziert (1960 im Bild unten). Auf diesem Vektor wird der Generator G′t darauf trainiert, verfeinerte Details auf alle Untermodelle zu übertragen. Abschließend wird eine Maske auf das Eingabebild angewendet, um das Modell zu ermutigen, die Gesichtsdetails des Porträts beizubehalten.

Nach der Feinabstimmung aller Untermodelle stellte das Forschungsteam fest, dass die FTT-Untermodelle verschiedener Epochen (orange im Bild unten) erfolgreich im übergeordneten Modell (blau im Bild unten) erfasst wurden, während sich die Frisuren änderten und Make-up. Porträtmerkmale jedes Bildes.

Dieses neue synthetische Bild-Framework hat zwei große Highlights: Erstens erfüllt es den Wunsch von Porträts, die durch die Zeit reisen, und zweitens kann diese Technologie auch bei der Zeittransformation des Gesichts die meisten Details des Porträts beibehalten.

Obwohl der Datensatz immer noch geringfügige Abweichungen aufweist (z. B. sind in Bildern aus dem frühen 20. Jahrhundert mehrere Frauen mit kurzen Haaren zu sehen), was zu Inkonsistenzen in den Ausgabebildern führt, ist dieses Modell realistischer als frühere Arbeiten. Viel verbessert.

„The Face Traveling Through Time“ beginnt mit dem ersten Schritt der Zeitreise. Bei solch einem hohen Maß an Genauigkeit fragt man sich: Diesmal sind es Porträts, die über die Zeit hinausgehen, aber wie sieht es beim nächsten Mal aus?

Referenz:

https://www.marktechpost.com/2022/11/09/latest-artificial-intelligence-ai-research-proposes-a-method-to-transform-faces-through-time/

https://facesthroughtime.github.io/

Das obige ist der detaillierte Inhalt vonKönnen Fotos durch die Zeit reisen? Das neue Modell „Gesichter reisen durch die Zeit' verwandelt sich in eine KI-Zeitmaschine. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

die Funktionsnutzung

die Funktionsnutzung

So verwenden Sie den Befehl „find', um Dateien unter Linux zu finden

So verwenden Sie den Befehl „find', um Dateien unter Linux zu finden

Der Unterschied zwischen Unix und Linux

Der Unterschied zwischen Unix und Linux

Was bedeutet der Befehl rm-rf unter Linux?

Was bedeutet der Befehl rm-rf unter Linux?

Flex-Tutorial

Flex-Tutorial

Der Computer fordert zur Lösung des NSIS-Fehlers auf

Der Computer fordert zur Lösung des NSIS-Fehlers auf

Einführung in die Implementierungsmethoden für Java-Spezialeffekte

Einführung in die Implementierungsmethoden für Java-Spezialeffekte

Welche Bildbearbeitungssoftware gibt es?

Welche Bildbearbeitungssoftware gibt es?