Vor einiger Zeit trainierte das Yuanyu Intelligent Development Team ein großes Modell für funktionale Dialoge, ChatYuan, ähnlich wie ChatGPT, und eröffnete eine Testoberfläche in der Webversion.

Jetzt können Sie einen ChatYuan auch auf Ihrem eigenen Computer bereitstellen!

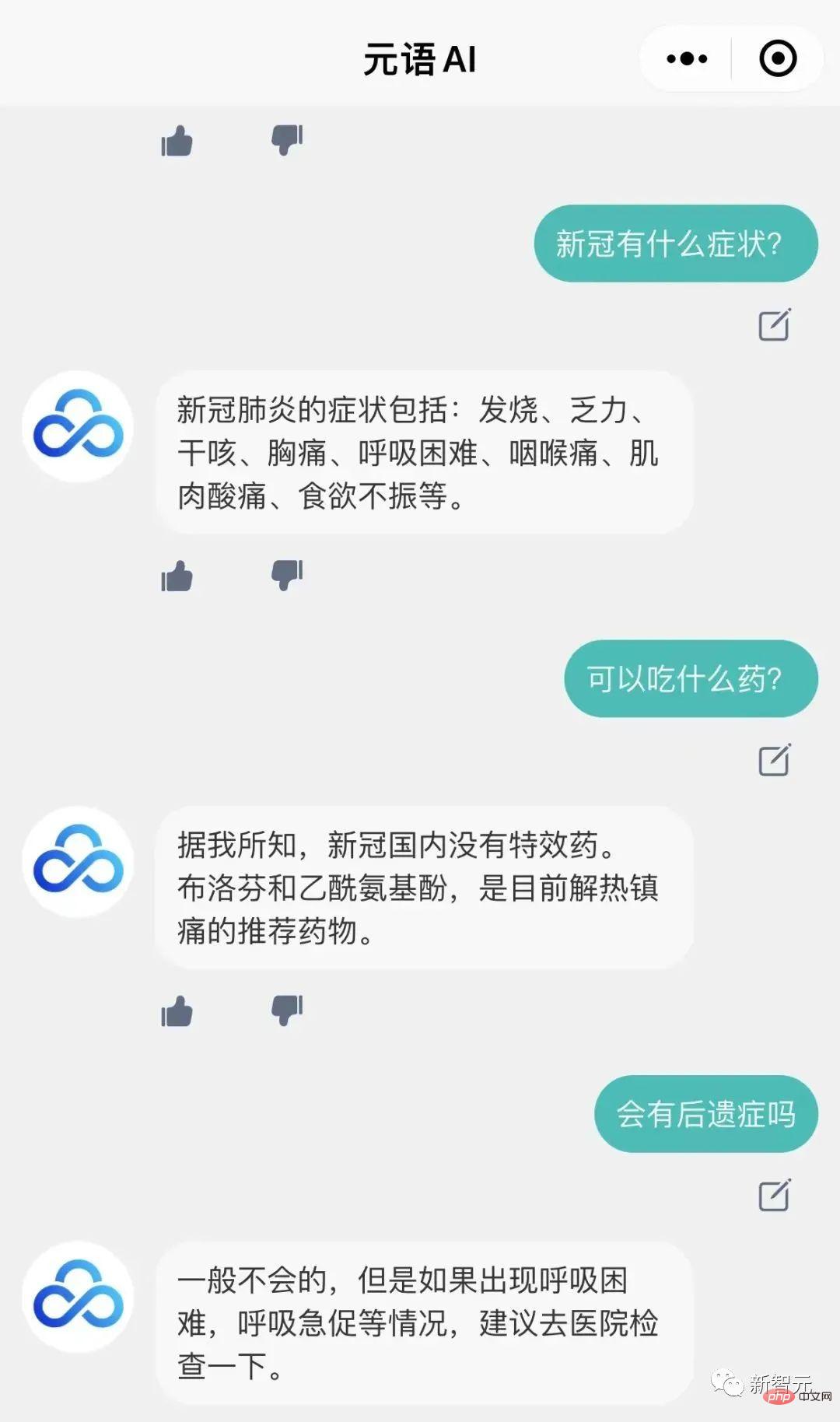

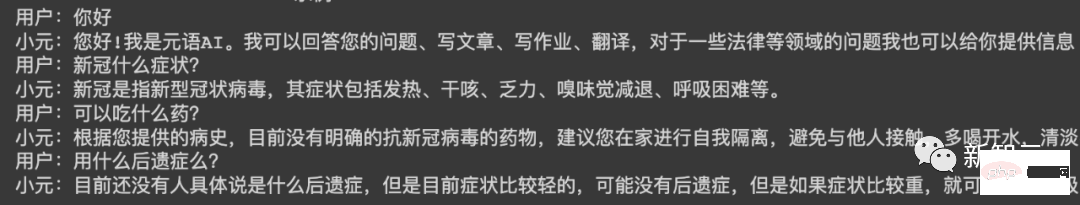

Das Modell kann in Frage- und Antwortszenarien verwendet werden und kann Wird für Dialoge und verschiedene Aufgaben basierend auf dem Kontext verwendet, einschließlich kreativem Schreiben, und kann auch Fragen in Bereichen wie Recht und COVID-19 beantworten.

und unterstützt das Zero-Sample-Lernen bei allen chinesischen Aufgaben, indem es Eingabeaufforderungen bereitstellt und fast 30 Kategorien der Textgenerierung, Informationsextraktion und des Verstehens verschiedener Chinesisch unterstützt Aufgaben.

ChatYuan basiert auf PromptCLUE-large, kombiniert mit Hunderten von Millionen funktionaler Fragen und Antworten und mehreren Runden von Dialogdaten. Die Modellparameter betragen 770 Millionen Der Videospeicher beträgt etwa 6 GB und eine zivile Grafikkarte kann geladen und verwendet werden. Das Modell steht derzeit zum Download bereit.

PromptCLUE ist auf 100 Milliarden chinesische Token-Körper vorab trainiert, hat insgesamt 1,5 Billionen chinesische Token gelernt und führt aufgabenbasierte Prompt-Schulungen für Hunderte von Aufgaben durch.

Für Verständnisaufgaben wie Klassifizierung, Stimmungsanalyse, Extraktion usw. kann das Etikettensystem für eine Vielzahl von Generierungsaufgaben angepasst werden generiert.

1. Github

# 🎜🎜#

Projektadresse: https://github.com/clue-ai/ChatYuan#🎜 🎜 Huggingface 🎜#

Projektadresse: https://huggingface.co/ClueAI/ChatYuan-large-v1 #🎜🎜 🎜 🎜# 3. 🎜 #Projektadresse: https://modelscope.cn/models/ClueAI/ChatYuan-large

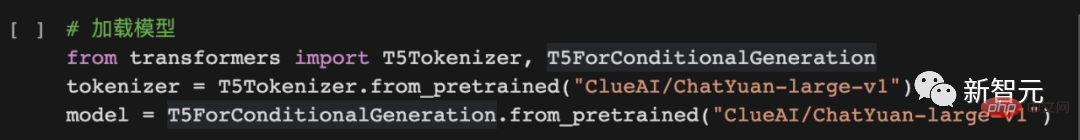

Modell laden :

Modelle für prädiktives Denken verwenden:

#🎜🎜 #

#🎜🎜 PaddlePaddle#🎜 🎜#

https://aistudio .baidu.com/aistudio/projectdetail/5404182 Modelladresse: https://huggingface.co/ClueAI/ChatYuan-large-v1-paddle 1. Organisieren Sie die Daten Die Daten sind in einem einheitlichen Format organisiert und bestehen aus zwei Teilen: Eingabe (Input) und Ausgabe (Output). Für eine einzelne Frage- und Antwortrunde oder Generierung: Eingabe: Aufgabenbeschreibung + Eingabetext Ausgabe: der Text, den das System vorhersagen muss, wie nach „Xiaoyuan“ in angezeigt Das Bild unten enthält den Inhalt. Für Gespräche mit mehreren Runden: Eingabe: Aufgabenbeschreibung + oben + Eingabetext Ausgabe: der Text, den das System vorhersagen muss, wie im Bild unten „Xiao Yuan“ gezeigt den folgenden Inhalt. Single-Turn-Konversationsdatenformat: Verwenden Sie Ihre eigenen Daten, um das Modell zu trainieren

Multiturn-Konversationsdatenformat:

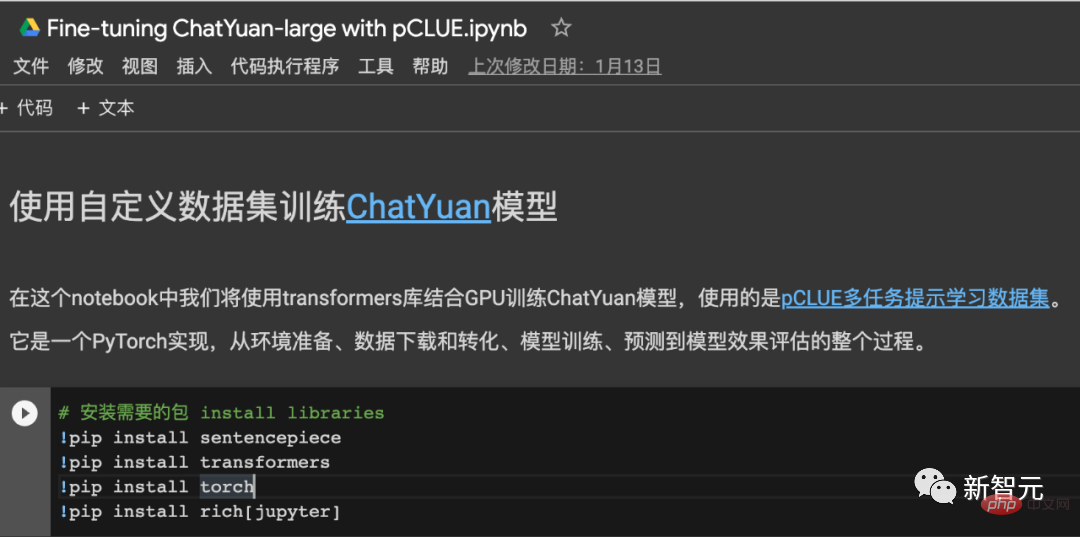

2. Trainingsmodell

Informationen zum Trainingscode finden Sie unter:

Verwendung des pCLUE-Datensatzes für Training, Vorhersage und Effektüberprüfung, Pytorch-Implementierung – Online-Colab.

Github-Projekt: https://colab.research.google.com/drive/1lEyFhEfoc-5Z5xqpEKkZt_iMaojH1MP_?usp=sharing

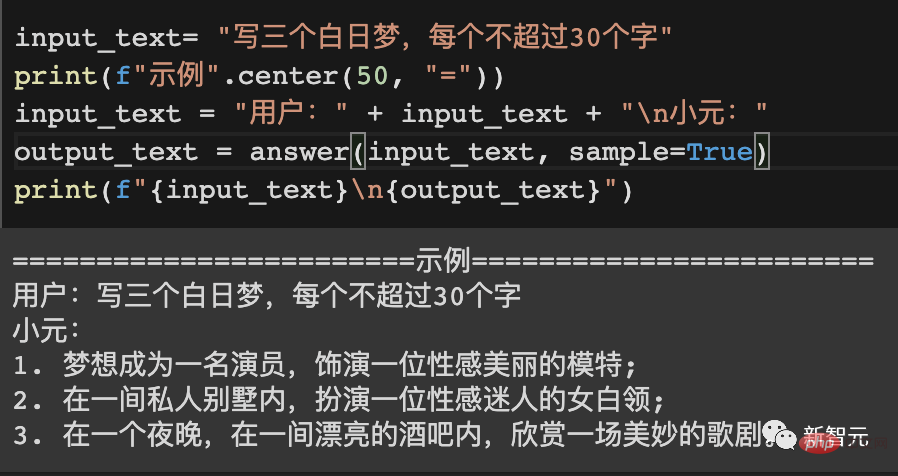

====== =====Beispiel 1==========

Benutzer:

Was können Sie tun

Xiaoyuan:

Hallo! Ich bin Yuanyu AI. Ich kann Ihre Fragen beantworten, Artikel schreiben, Aufgaben übernehmen, übersetzen und Ihnen auch Informationen zu rechtlichen und anderen Themen geben.

==========Beispiel 2==========

Benutzer:

Schreiben Sie ein Gedicht über den Winter

Xiao Yuan:

Die Winternacht ist ruhig und kalt,

Wolken schweben am Himmel,

auf dem gefrorenen weißen Schnee,

kalt wie Schnee.

Schneeflocken schmelzen zu Eis,

Wie fallende Schneeflocken,

Im kalten Winter

spüren Sie die Freude des Frühlings.

Im Winter

der Wind und der Schnee ließen allmählich nach,

es herrschte Stille,

Holen Sie sich Glück und Wärme nach Hause.

==========Beispiel 3==========

Benutzer:

Im Praktikum für Vorschulerziehung, am Schüler Seite Es wird Probleme geben, bitte schlagen Sie Verbesserungsmaßnahmen vor. 800 Wörter. usw., die erforderlich sind. Wir unternehmen Schritte, um diese Probleme zu lösen.

Zuallererst müssen wir während des Praktikumsprozesses das Teambewusstsein der Schüler fördern, die Zusammenarbeit zwischen Schülern und Lehrern stärken, die Kommunikation mit den Eltern stärken und ihre Kommunikationsfähigkeiten verbessern. Darüber hinaus müssen wir auch die Unabhängigkeit der Schüler stärken, ihnen ermöglichen, selbstständig zu denken, mit Lehrern und Eltern zu kommunizieren und ihre Unabhängigkeit zu fördern.

Darüber hinaus müssen wir den Schülern in der täglichen Arbeit auch entsprechende Chancen und Möglichkeiten bieten, damit die Schüler mehr Kontakt zur Gesellschaft haben und an mehr sozialen Aktivitäten teilnehmen, ihr Verständnis für Gesellschaft und Schule vertiefen und ihre Initiative fördern können , Positivität und Innovationsgeist.Schließlich müssen wir auch auf die Probleme achten, die Studenten während des Praktikums haben, insbesondere auf mangelnde Kooperation, Abhängigkeit, mangelndes Wissen zum Teilen, Aufschieben usw. Diese Studenten sollten unsere Aufmerksamkeit erregen und angemessene Verbesserungen formulieren Maßnahmen, diese Probleme zu verbessern.

Technologie und Trainingsprozess

ChatYuan ist ein Modell, das durch Weiterbildung auf Basis von PromptCLUE erworben wird. Es beseitigt Textverständnis- und Informationsextraktionsaufgaben und stärkt das Lernen und Trainieren von Fragen und Antworten, Dialogen und verschiedenen generativen Aufgaben.

Angesichts der Tatsache, dass Mehrrundendialoge leicht durch Kontext beeinträchtigt werden, Anti-Interferenz-Daten; wird hinzugefügt, damit das Modell bei Bedarf irrelevante Kontexte ignorieren kann; das Lernen von Benutzer-Feedback-Daten wird hinzugefügt, sodass das Modell nicht nur über bestimmte allgemeine Sprachverständnisfähigkeiten und spezifische Aufgabengenerierungsfunktionen verfügt, sondern auch besser auf Benutzerabsichten reagieren kann.

PromptCLUE-Lernprozess

Das obige ist der detaillierte Inhalt vonFür die Bereitstellung von inländischem ChatGPT sind nur 6 GB Videospeicher erforderlich! Das ChatYuan-Modell steht zum Download bereit: das erste funktionale Dialog-Open-Source-große chinesische Modell der Branche. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

ChatGPT-Registrierung

ChatGPT-Registrierung

Inländische kostenlose ChatGPT-Enzyklopädie

Inländische kostenlose ChatGPT-Enzyklopädie

So installieren Sie ChatGPT auf einem Mobiltelefon

So installieren Sie ChatGPT auf einem Mobiltelefon

Kann Chatgpt in China verwendet werden?

Kann Chatgpt in China verwendet werden?

So lösen Sie zu viele Anmeldungen

So lösen Sie zu viele Anmeldungen

Welche Arten von Systemarchitekturen gibt es?

Welche Arten von Systemarchitekturen gibt es?

Konvertieren Sie PDF-Dateien in CAD-Zeichnungen

Konvertieren Sie PDF-Dateien in CAD-Zeichnungen

So lösen Sie das Problem, dass die DLL nicht geladen werden kann

So lösen Sie das Problem, dass die DLL nicht geladen werden kann